password: ly123

hexo命令

clean:

1 | hexo clean |

生成网页

1 | hexo g |

部署:

1 | hexo d |

在本机上部署

1 | hexo s |

hexo添加对数学公式的支持

安装hexo-filter-mathjax和hexo-renderer-pandoc渲染器,

教程可以参考hexo-filter-mathjax项目主页:

https://github.com/next-theme/hexo-filter-mathjax

另外也可以参考下,里面有如何卸载原来的渲染器的过程,否则有冲突: https://blog.csdn.net/weixin_45511189/article/details/115798563

还有安装hexo-renderer-pandoc记得安装pandoc,不然会报错:

https://github.com/jgm/pandoc/releases

项目上有注意事项,仔细看格式,不然可能打印不出来

设置获取本机 ip 的别名

1 | 通过ifconfig获取当前机器的ip地址 |

docker 命令:

创建macvlan网络

为了能够让docker启动的容器作为家庭网络中的旁路由,因此需要创建macvlan网络。

其中

192.168.3.1为你局域网的网关,em1为你机器的网卡名称,这两个请根据实际情况修改。

- (可选)让docker监听ipv6。 编辑etc/docker/daemon.json文件

1 | { |

重启docker

1 | sudo systemctl restart docker |

- 创建macvlan 没有ipv6的版本

1 | docker network create -d macvlan \ |

我这边本地dockerinclash配置如下:

1 | docker network create -d macvlan --subnet=192.168.1.0/24 --gateway=192.168.1.1 -o parent=eth0 -o macvlan_mode=bridge macnet |

有ipv6的版本

1 | docker network create -d macvlan --ipv6 \ |

注意看含义,有的值需要变

查看网络:

1 | docker network ls |

制作docker镜像并创建容器

- 获取代码

1 | git clone https://github.com/UntaggedRui/clashindocker |

- 更改地址

docker-compose.yml中的ipv4_address为你的ip地址. - 更改

config.yml中的proxy-provider的url为你的机场订阅地址. - 启动容器

1 | docker compose up -d |

如果遇到无法访问或者启动的问题,可以查看一下日志:

1 | docker-compose logs -f |

或者

在有项目的Dockerfile的目录运行

docker build -t TARGET_NAME .

TARGET_NAME为镜像名称和版本,可以自己起个名字

官方是:

1 | docker build --tag name:tag . #如docker build . -t keynetworks/ztncui:latest |

生成并运行容器

docker pull ghcr.io/raywangqvq/bilibili_tool_pro docker run -d --name="bili" -v /bili/Logs:/app/Logs -e Ray_DailyTaskConfig__Cron="0 15 * * *" -e Ray_LiveLotteryTaskConfig__Cron="0 22 * * *" -e Ray_UnfollowBatchedTaskConfig__Cron="0 6 1 * *" -e Ray_VipBigPointConfig__Cron="7 1 * * *" ghcr.io/raywangqvq/bilibili_tool_pro

查看实时日志

docker logs -f bili

删除容器

docker rm bili

进入容器

docker exec -it bili /bin/bash

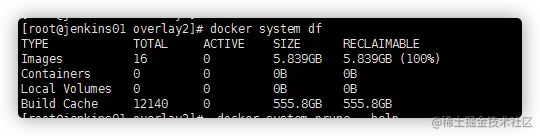

查看一下缓存情况:

1 | docker system df |

可以发现,存在大量使用 docker build 命令时产生的镜像缓存 (Build Cache) ,下面使用命令 prune 将其彻底清理。

1 | docker system prune --help |

docker国内镜像加速

对于国内加速镜像,直接设置镜像地址就好了: 编辑/etc/docker/daemon.json添加

1 | { |

也可以用其它镜像比如阿里云 或者 daocloud 等等。

docker pull 拉取镜像时设置代理

docker 的代理设置是一件比较麻烦的事情,很容易出问题,但是弄懂了也还是比较清楚。

首先, docker pull 和 docker build/docker run 使用代理的方式不一样!

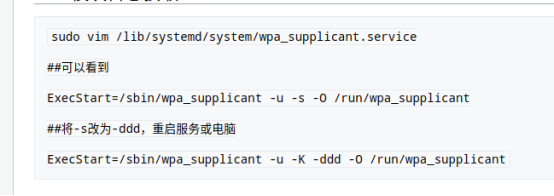

docker pull 的代理被 systemd 接管,所以需要设置 systemd…

sudo vim /etc/systemd/system/docker.service.d/http-proxy.conf

1 | [Service] |

这里的127.0.0.1是直接用了本机的 http 代理,然后重启服务才能生效

1 | sudo systemctl daemon-reload |

可以通过sudo systemctl show --property=Environment docker看到设置的环境变量。

然后docker pull就会使用代理啦!

这里 HTTP 代理可以通过你的代理软件开出来,如果你的代理软件只能开出来 socks5 代理的话,你可以用 polipo 开一个 http 代理使用

build 镜像时使用代理

在 build 时添加 --build-arg 参数来设置生成镜像时使用的环境变量

1 | docker build --build-arg http_proxy=http://172.17.0.1:8123 --build-arg https_proxy=http://172.17.0.1:8123 -t image_name . |

这里需要注意的是 ip 地址用了默认虚拟网卡docker0 的地址172.17.0.1,因为build的时候network参数默认为bridge,即docker内部会使用这个网段,因为要访问到宿主机的代理只能这样访问; 另外,也可以设置参数--network=host 来直接和宿主机共用网络,就能直接使用127.0.0.1来访问到宿主机了

设置 docker 全局代理

设置方法参考官方文档: https://docs.docker.com/network/proxy/

注意新版和旧版本(17.07以前)设置方法不一样,比旧版更简单而且不需要重启服务,网上文章基本都是针对旧版本的,可能未来又变化了,所以多看官方文档~ 以及这种设置方法只对 build 和 run 的容易有用, docker pull 要按照上面的方法设置。

vim ~/.docker/config.json

1 | { |

这样设置后,build和run都会将http_proxy和https_proxy ftp_proxy变量设置成对应的代理地址,如果你在容器里面不想使用这个代理了,需要export http_proxy= 和 export https_proxy= 将两个变量设置为空

注意:

仅支持 http https ftp 协议,不支持 socks5 协议(2022.3.24,未来不一定,官方文档为准),可以使用polipo创建一个http代理服务,参考https://neucrack.com/p/275

这里使用了172.17.0.1(docker 虚拟网卡地址), 而不是127.0.0.1, 这是因为这是从容器内部的角度来看的, 容器内部要使用代理,默认情况下只能访问这个虚拟网卡的地址, 127.0.0.1是容器内部, 如果代理在宿主机, 要使用 虚拟网卡的地址才能访问到.

这个文件一旦存在, docker就会使用这里面的代理, 包括创建的容器都会使用它。 所以不需要代理了, 需要关闭代理, 就是把文件重命名一下就好了, 这点用起来确实挺麻烦,也许未来会优化体验吧。

注意, 一个容器一旦生成, 这些环境变量(http_proxy https_proxy ftp_proxy no_proxy)就会被继承到容器中, 就算把config.json删除, 这个容器依然使用创建时的环境变量,可以手动在容器内重新设置这些环境变量, 这点也挺容易让人头疼的, 一定要注意。

比如 有个镜像叫 imageA, 现在设置~/.docker/config.json也就是有代理, 然后docker run创建容器 A, 然后再重命名config.json, 创建容器B, 然后会发现无论现在怎么修改config.json, 容器A B都会使用它被创建时的代理设置,即容器A使用代理, 容器B不使用代理

容器使用宿主机的代理的几种方法总结

和 build 时类似,只需要在 生成容器时(run -e http_proxy=...) 或者 容器中 设置环境变量http_proxy和https_proxy变量即可,同样需要注意容易使用的网络类型是bridge还是host,根据类别设置正确的代理 ip 地址

方法一: 直接在容器内使用(推荐

1 | export ALL_PROXY='socks5://172.17.0.1:1080' |

这里ip地址使用的是宿主机的ip

方法二: 与宿主机共享网络时直接在容器内使用 创建容器时使用--network=host参数

然后在docker内设置代理,比如全局代理

1 | export ALL_PROXY='socks5://127.0.0.1:1080' |

这样就可以使用宿主机的代理了

但是要注意, 如果是用--network=host,这样的话使用 -p 参数映射端口就没用了, 即所有端口都是开放和宿主机共享的

方法三: 映射代理端口后直接在容器内使用 docker run时带参数-p映射代理的端口到容器, 在容器里面使用即可,比如:

1 | docker run -p 1080:1080 ..... |

方法四: docker配置全局代理,以在生成容器时自动设置代理变量 设置 docker 全局代理,比如设置了http://172.17.0.1:8123, 容器内全都会走这个代理,除了配置文件中的白名单里面的地址以外

注意: 全局代理和 --network=host 参数只能用一个,不然就容易混乱

git配置和取消代理

1 | git config --global http.proxy http://127.0.0.1:7890 |

或者直接修改 ~/.gitconfig

仅为github.com设置socks5代理(推荐这种方式,

公司内网就不用设代理了, 多此一举):

git config --global http.https://github.com.proxy socks5://127.0.0.1:1086

其中1086是socks5的监听端口, 这个可以配置的, 每个人不同,

在macOS上一般为1086. 设置完成后, ~/.gitconfig文件中会增加以下条目:

1 | [http "https://github.com"] |

ssh访问 需要修改~/.ssh/config文件, 没有的话新建一个. 同样仅为github.com设置代理:

1

2

3Host github.com

User git

ProxyCommand nc -v -x 127.0.0.1:7890 %h %p如果是在Windows下, 则需要个性%home%.ssh, 其中内容类似于:

1

2

3Host github.com

User git

ProxyCommand connect -S 127.0.0.1:7890 %h %p这里-S表示使用socks5代理, 如果是http代理则为-H. connect工具git自带, 在.

python模块化

Python init.py 作用详解

init.py 文件的作用是将文件夹变为一个Python模块,Python 中的每个模块的包中,都有__init__.py 文件。

通常__init__.py 文件为空,但是我们还可以为它增加其他的功能。我们在导入一个包时,实际上是导入了它的__init__.py文件。这样我们可以在__init__.py文件中批量导入我们所需要的模块,而不再需要一个一个的导入。

init.py中还有一个重要的变量,all, 它用来将模块全部导入。

1 | # package |

init.py中还有一个重要的变量,all, 它用来将模块全部导入。

1 | # __init__.py |

这时就会把注册在__init__.py文件中__all__列表中的模块和包导入到当前文件中来。

可以了解到,init.py主要控制包的导入行为。要想清楚理解__init__.py文件的作用,还需要详细了解一下import语句引用机制:

可以被import语句导入的对象是以下类型:

- 模块文件(.py文件)

- C或C++扩展(已编译为共享库或DLL文件)

- 包(包含多个模块)

- 内建模块(使用C编写并已链接到Python解释器中)

当导入模块时,解释器按照sys.path列表中的目录顺序来查找导入文件。

1 | import sys |

其中list第一个元素空字符串代表当前目录。

关于.pyc 文件 与 .pyo 文件

.py文件的汇编,只有在import语句执行时进行,当.py文件第一次被导入时,它会被汇编为字节代码,并将字节码写入同名的.pyc文件中。后来每次导入操作都会直接执行.pyc 文件(当.py文件的修改时间发生改变,这样会生成新的.pyc文件),在解释器使用-O选项时,将使用同名的.pyo文件,这个文件去掉了断言(assert)、断行号以及其他调试信息,体积更小,运行更快。(使用-OO选项,生成的.pyo文件会忽略文档信息)

导入模块

模块通常为单独的.py文件,可以用import直接引用,可以作为模块的文件类型有.py、.pyo、.pyc、.pyd、.so、.dll

在导入模块时,解释器做以下工作:

- 已导入模块的名称创建新的命名空间,通过该命名空间就可以访问导入模块的属性和方法。

- 在新创建的命名空间中执行源代码文件。

- 创建一个名为源代码文件的对象,该对象引用模块的名字空间,这样就可以通过这个对象访问模块中的函数及变量

import 语句可以在程序的任何位置使用,你可以在程序中多次导入同一个模块,但模块中的代码仅仅在该模块被首次导入时执行。后面的import语句只是简单的创建一个到模块名字空间的引用而已。

sys.modules字典中保存着所有被导入模块的模块名到模块对象的映射。

导入包

多个相关联的模块组成一个包,以便于维护和使用,同时能有限的避免命名空间的冲突。一般来说,包的结构可以是这样的:

1 | package |

有以下几种导入方式:

1 | import subpackage1.a # 将模块subpackage.a导入全局命名空间,例如访问a中属性时用subpackage1.a.attr |

使用from语句可以把模块直接导入当前命名空间,from语句并不引用导入对象的命名空间,而是将被导入对象直接引入当前命名空间。

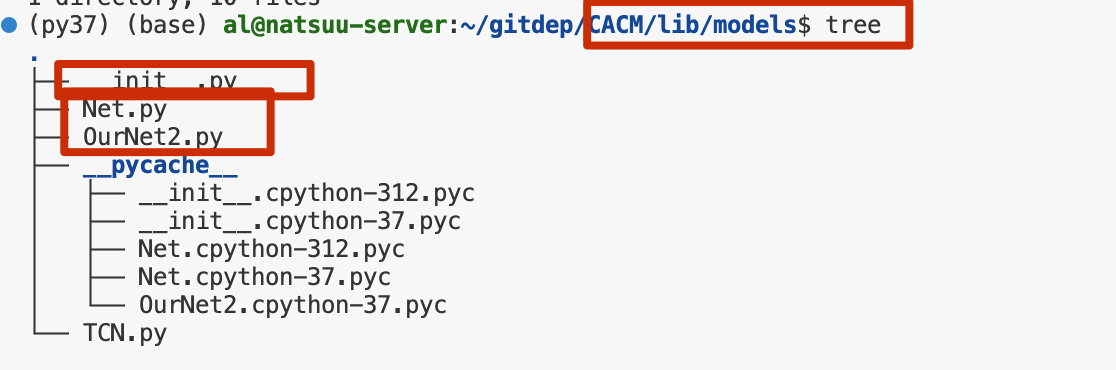

需求 1

现在我有 models 文件夹作为一个模块,其目录结构如下:

现在我想实现一个 get_cls_net函数,定义如下,其中 OurNet 和CACMNet放在 Net.py,OurNet2放在 OurNet2.py,我要怎么组织起来:

1 | def get_cls_net(config, **kwargs): |

解决方案:

好的,用户现在有一个问题,需要实现一个get_cls_net函数,根据不同的模型名称来实例化对应的类。他们的项目结构里,各个模型分布在不同的文件中,比如OurNet和CACMNet在Net.py,而OurNet2在OurNet2.py里。首先,我需要理解用户的需求,以及他们可能遇到的问题。

首先,用户提到models文件夹作为模块,里面有多个Python文件。他们想要组织这些模型类,使得get_cls_net函数能够正确导入这些类并创建实例。目前,这个函数中有一个模型名称到类的映射,但用户可能遇到的问题是,当这些类分布在不同的文件中时,如何正确导入它们,避免出现导入错误或者循环依赖的问题。

接下来,我需要分析用户给出的目录结构。models模块下有__init__.py,说明这是一个包。各个模型类分布在不同的文件中:CACMNet和OurNet在Net.py,OurNet2在OurNet2.py。用户希望在get_cls_net函数中通过模型名称动态获取对应的类。

可能的解决方案是,在__init__.py中集中导入这些类,这样当其他文件从models模块导入时,可以直接引用这些类,而不需要每个文件都单独导入。例如,在__init__.py中,使用from .Net import OurNet, CACMNet和from .OurNet2 import OurNet2,这样在get_cls_net函数中就可以通过models模块直接访问这些类。

然后,用户需要将get_cls_net函数放在哪里?用户可能希望将这个函数放在models模块的某个文件中,比如__init__.py或者单独的文件里。但根据常见的做法,可能会建议将函数放在__init__.py中,或者创建一个新的文件如model_factory.py来存放这个函数,这样可以保持代码的整洁。

不过,用户提供的示例代码中,get_cls_net函数需要访问各个模型类,所以需要确保这些类已经被正确导入到当前的命名空间中。如果这个函数被放在models模块的__init__.py中,那么当用户调用models.get_cls_net时,可以直接使用这些类。或者,用户可能希望将这个函数放在另一个文件中,比如model_factory.py,这时候需要确保该文件正确地从models模块导入所需的类。

另一个需要注意的问题是,如何避免循环导入。如果各个模型文件之间有相互依赖的情况,可能会导致导入错误。因此,集中导入在__init__.py中可以减少这类问题,因为每个模型文件只需要在__init__.py中被导入一次,其他地方通过models模块引用。

接下来,用户需要确保每个模型类在对应的文件中被正确定义。比如,Net.py中应该包含OurNet和CACMNet两个类的定义,而OurNet2.py中有OurNet2类。此外,每个类需要有一个接受config和**kwargs参数的构造函数,以及init_weights方法,这样才能在get_cls_net中被正确实例化和初始化。

然后,关于如何组织代码,可能的步骤是:

在models/init.py中导入所有模型类,使它们成为模块的顶级导出。 在models目录下的适当位置定义get_cls_net函数,比如在__init__.py中,或者单独的文件中。 确保在get_cls_net函数中能够正确引用这些类,比如通过from models import CACMNet, OurNet, OurNet2或者直接使用全局映射。

用户提供的示例代码中的model_mapping直接使用了类名,这意味着这些类必须在get_cls_net函数的定义范围内可用。因此,如果这个函数被放在models模块的__init__.py中,并且已经在__init__.py中导入了这些类,那么映射就可以正常工作。

总结解决方案:

在models/init.py中导入各个模型类,使得外部可以通过from models import ...来访问。 将get_cls_net函数放在models模块的适当位置,比如__init__.py或者一个单独的文件如model_factory.py。 在函数中建立模型名称到类的映射,使用导入的类。

可能的代码结构:

在models/init.py中:

from .Net import CACMNet, OurNet from .OurNet2 import OurNet2

def get_cls_net(config, **kwargs): model_mapping = { 'CACMNet': CACMNet, 'OurNet': OurNet, 'OurNet2': OurNet2 }

其余代码...

这样,当用户使用时,可以导入get_cls_net函数:

from models import get_cls_net

或者,如果函数放在单独的文件中,比如model_factory.py:

在models/model_factory.py中:

from . import CACMNet, OurNet, OurNet2

def get_cls_net(config, **kwargs): model_mapping = { ... }

然后在__init__.py中导入该函数:

from .model_factory import get_cls_net

这样用户同样可以从models模块直接导入。

此外,需要确保各个模型类的文件没有语法错误,比如Net.py中的类定义正确,参数正确。比如,每个模型类应该接受config作为参数,并且有init_weights方法。

最后,用户可能需要处理可能的错误,比如模型名称不存在时的异常处理,这部分在示例代码中已经处理了,所以只需要确保映射正确即可。

可能的错误点:

导入路径错误,导致类无法正确导入到__init__.py中。 模型类没有正确实现所需的构造函数或方法。 文件命名或路径问题,例如OurNet2.py是否正确命名,是否在models目录下。 如果用户将get_cls_net函数放在另一个文件中,比如attention.py或TCN.py中,需要确保该文件正确导入模型类。

测试步骤:

用户需要测试导入是否成功,可以尝试在Python中导入models模块,并检查是否有导入错误。例如:

python -c "from models import CACMNet, OurNet, OurNet2, get_cls_net"

如果没有错误,说明导入正确。然后测试get_cls_net函数能否正确创建实例。

综上,解决方案的核心在于正确组织__init__.py中的导入,并将get_cls_net函数放在合适的位置,确保映射中的类能够被正确引用。

根据当前目录结构和需求,建议按以下方式组织代码:

文件结构优化后的效果:

1 | python |

在models/init.py中写入:

1 | from .Net import CACMNet, OurNet |

各模型文件示例(Net.py):

1 | class CACMNet: |

使用方式:

1 | from models import get_cls_net |

假设config对象已包含MODEL.MODEL_NAME字段

1 | model = get_cls_net(config, other_params=value) |

优势说明:

集中式管理:所有模型类通过__init__.py统一暴露,调用时只需from models import ... 动态扩展:新增模型时只需在映射表添加条目 错误友好:清晰的错误提示和可用模型列表 权重初始化:强制所有模型类实现init_weights方法,保持接口统一

注意要点:

确保所有模型类都接收(config, **kwargs)参数 需要从项目中彻底清除pycache(建议添加.gitignore) 所有模型类文件需要保持无副作用代码(避免在模块层级写执行代码)

需求 2

如果 OurNet2.py 中要使用 Net.py 中的某些类,我要如何使用?比如说OurNet2.py中要使用 Net.py 中的 FeedForward类,我要如何 import

解决办法:

相对导入

1 | # OurNet2.py |

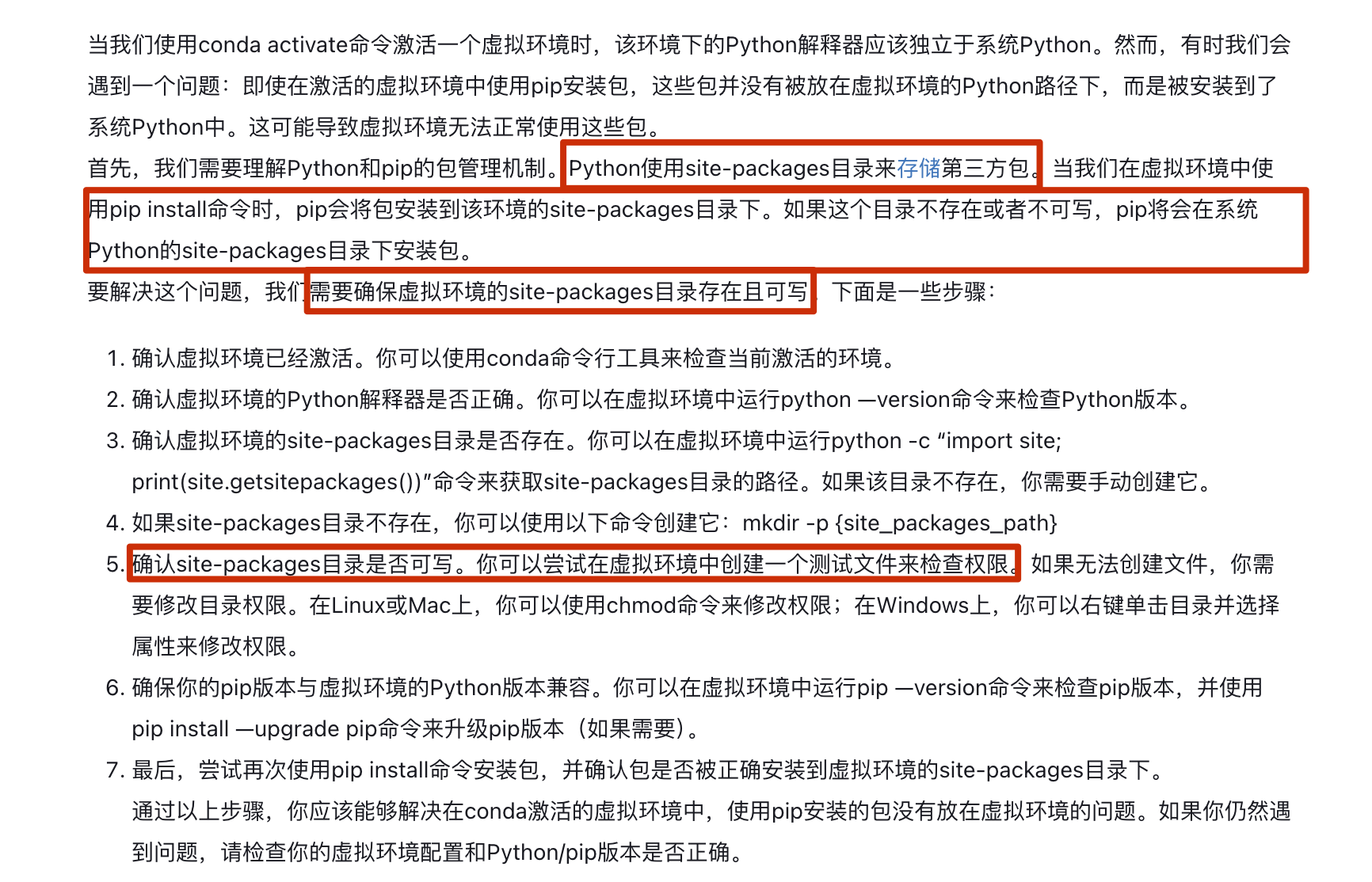

解决conda activate虚拟环境后,pip安装的包没放在虚拟环境的问题

许多公式都有π和e,可能的原因有什么?

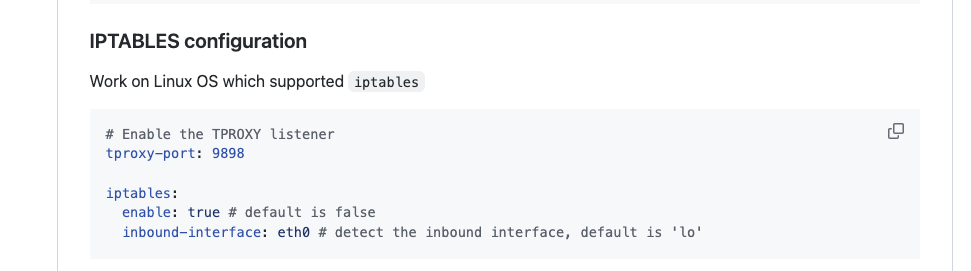

clash配置代理

要想让其他设备通过设置网关的方式将clash所在的设备设置为网关有三种方法:

开启ip转发功能。 mac: sudo sysctl -e net.inet.ip.forwarding=1 ubuntu: sudo sysctl -w net.ipv4.ip_forward=1

方法一:

安装官方提供的方法,将下面的内容添加到config.yml中,好像只支持linux,这个方法应该也相当于方法三,只不过是官方实现了,我后面才发现的:

1 | # Enable the TPROXY listener |

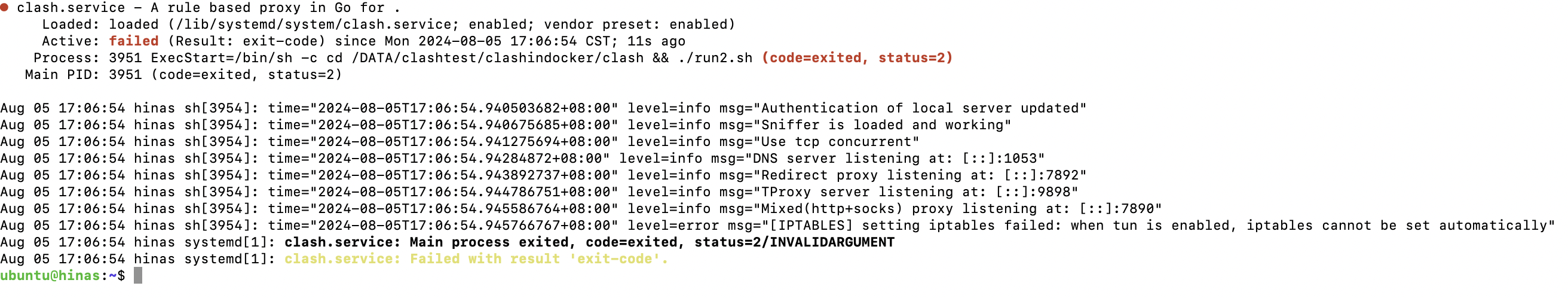

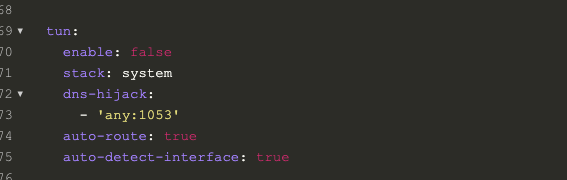

这种方式不能开tun模式,会报错如下:

方法二:

在config.yml开启tun模式.但是测试tun模式下我的该设备通过ddns配置的域名,域名能正确获取到公网ip,但是无法访问(我还没找到原因,网上没有相关的资料,感觉还是tun模式的实现原理的问题,或者说tun模式新增这个tun设备,在使用iptable将流量转发给这个设备再返回时出现了问题,唉不想研究,如果想研究我感觉按照下面的思路应该很容易发现问题出现的原因:看看打开tun模式运行了哪些iptables命令),所以我不打算用这种方式

方法三(建议使用方法一):

配置iptables规则,接管流量,好处是不影响通过域名访问该设备(有可能这台机器导致docker无法正常pull镜像(我一开始开启tun模式然后运行下面的 脚本遇到了,国内源也不行),唉,不想找解决办法了,反正我后面没遇到,我估计是当时我同时开启了tun模式和下面的脚本,iptables规则冲突了,可能流量被一边劫持了,遇到了应该只要开机别运行这个脚本然后重启电脑就好了,反正我当时是这么解决的)

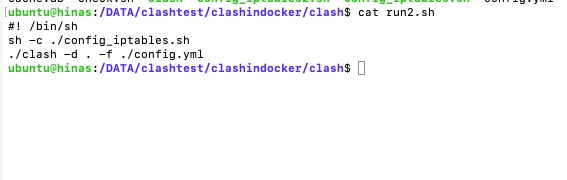

config_iptable.sh

1 | 在nat表中新建一个clash规则链 |

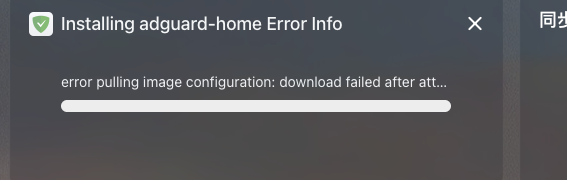

docker pull不了image(--------------------------------好吧,当我没说,只是adguard-home安装不了)

配置代理,反正我试了运行clash的机器上上面两种方式都还要执行这个步骤

1 | cat /etc/environment |

常见问题

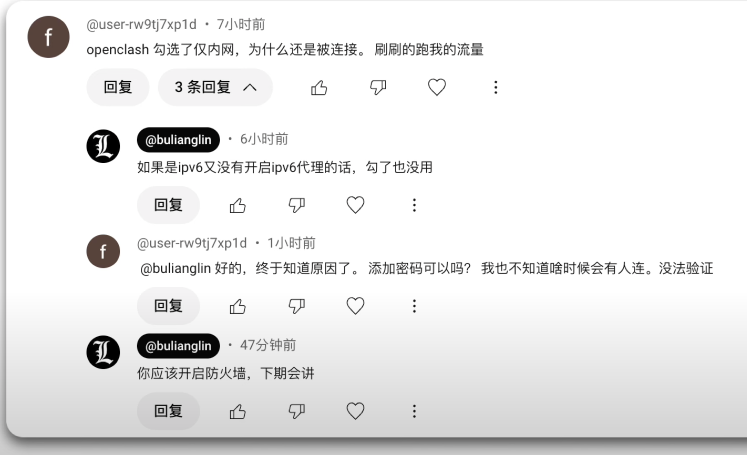

1、clash勾选了仅内网还是被跑流量

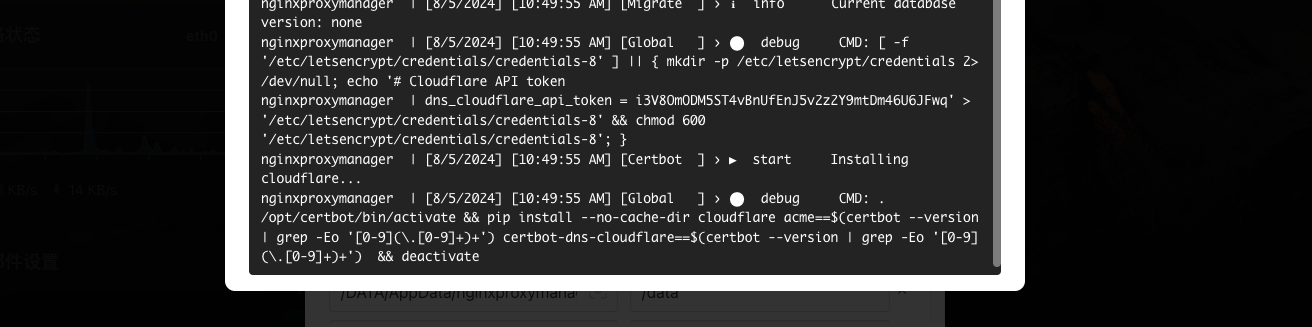

Nginx Proxy Manager输入账号密码点击登录却遇到bad gateway

解决办法:

等一会就行了,之后就发现能登录了,等一下是因为在初始化安装些东西

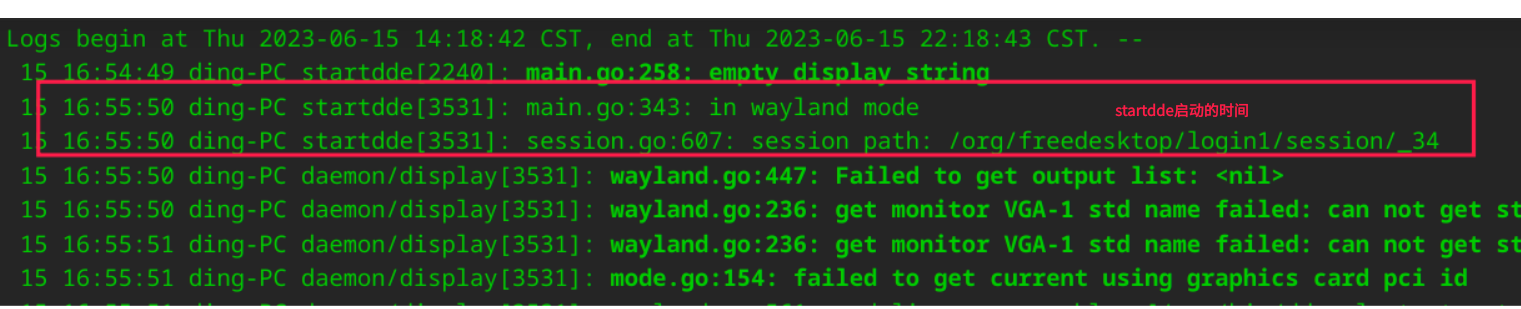

看日志发现报错如下:

certbot --version The 'certbot_dns_cloudflare._internal.dns_cloudflare' plugin errored while loading: No module named 'CloudFlare'. You may need to remove or update this plugin. The Certbot log will contain the full error details and this should be reported to the plugin developer.

光盘刻录:

过程: 开始刻录->卸载光盘->读取光盘内分段数据->数据打包->刻录。 系统刻录光盘日志 ~/.cache/deepin/discburn/uburn/xxxx/log

xorriso -dev /dev/sr0 -map /src/ /dest/ -volid 卷标 -close off -commit -eject

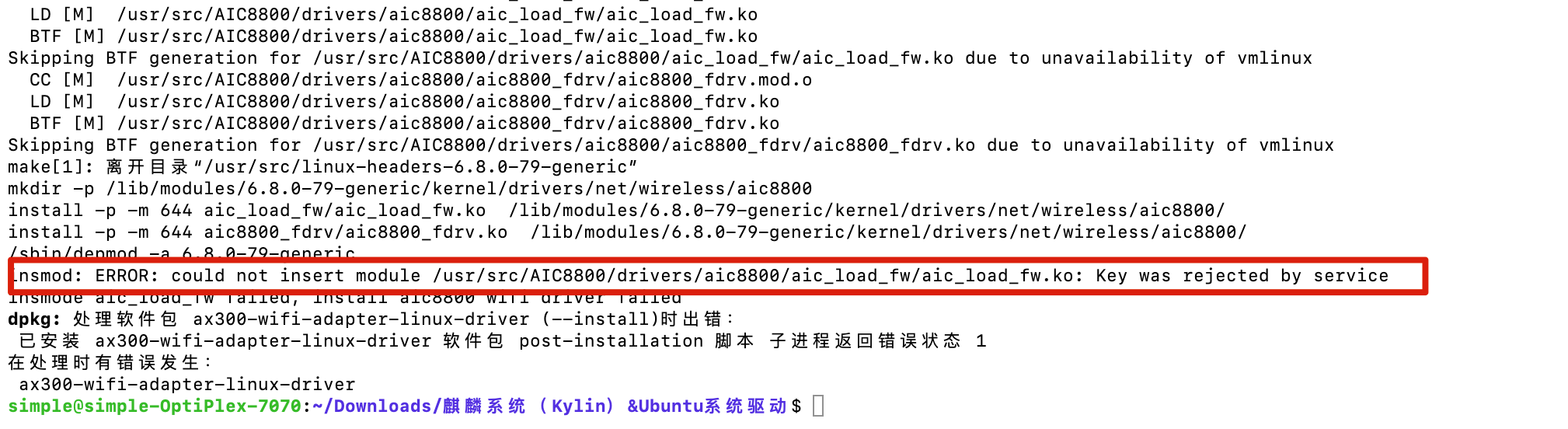

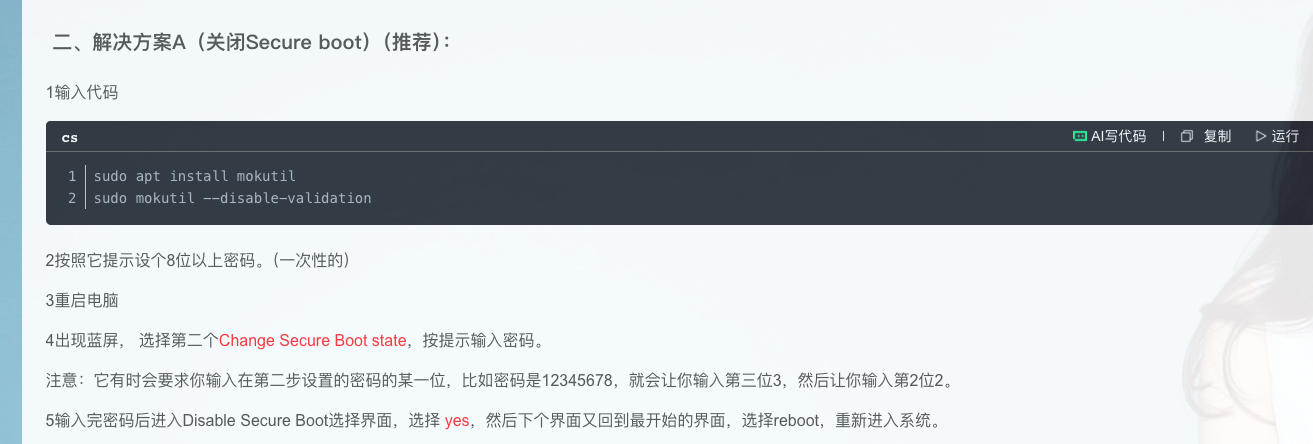

关闭 ubuntu 的签名

时区设置:

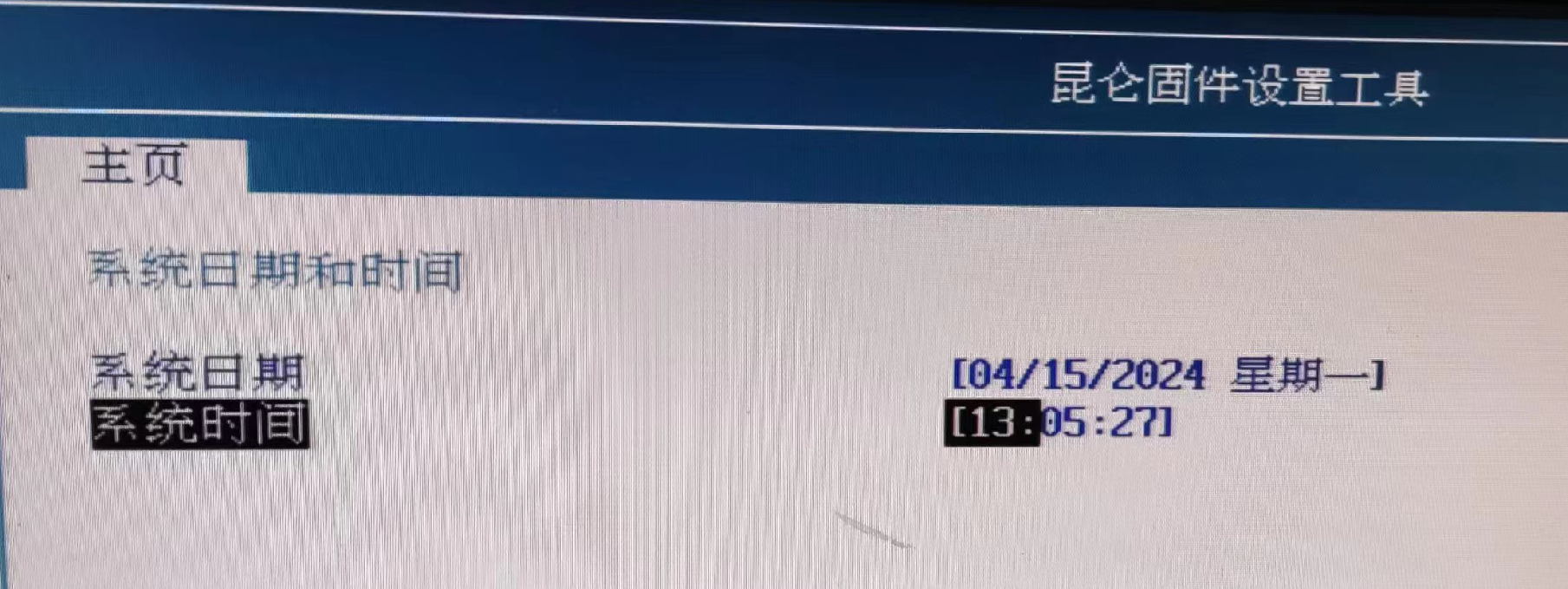

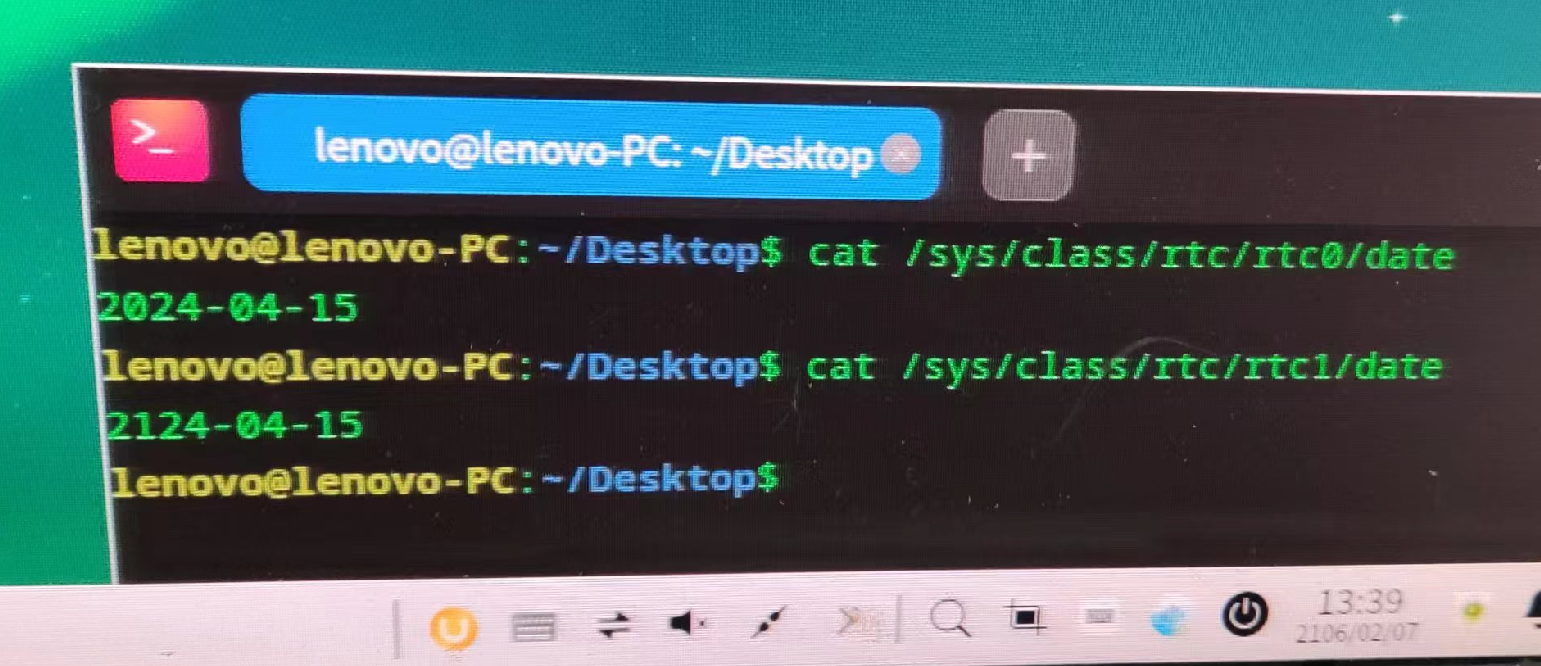

date -R #查看当期时区 tzselect #设置时区 systemd-timeryncd.service服务的配置文件位于“/etc/systemd”路径下,文件名称为“timesyncd.conf”,可以设置ntp服务器(deepin有 /etc/systemd/timesyncd.conf.d/deepin.conf如果某个Linux发行版和deepin一样具有/etc/systemd/system.d/timesyncd.conf文件夹,那么systemd-timesyncd.service服务将优先选择这个文件夹下的.conf文件作为自己的优先配置文件,而原有的/etc/systemd/timesyncd.conf将作为备用的配置文件,优先级相对较低。 4.3、典型故障——无论怎样修改时区,Linux系统始终都显示零区的格林尼治时间 出现这样的情况一般是因为/usr/share/zoneinfo目录遭到严重破坏造成的,针对这样的故障,最简单粗暴的方式就是将找到一套同版本、正常运行的Linux发行版,将其/usr/share/zoneinfo目录复制出来,对故障Linux系统的相关目录进行替换。

4.4、典型故障——安全软件在启动时强制打开操作系统时间同步功能,后因安全软件服务端时间错误导致时钟错误同步 在信创领域,Linux杀毒软件经常被安装在Linux电脑上,用于病毒查杀和违规外联等功能。而主流的Linux杀毒软件都具有审计功能,审计会产生大量的日志纪录,这些纪录需要有一个时间对应,因此这些杀毒软件的服务端会自带时钟同步,并且会在Linux终端启动完成后强制打开和配置操作系统的时钟同步功能,如果杀毒软件服务端的本地时间时错误的,或者说同一个局域网内有多个存在一定时间差的NTP服务器,将可能会对Linux终端带来时间上的错误。

sudo trace-bpfcc -tUK __alloc_pages_nodemask

systemctl set-property name parameter=value

pactl list short modules pacmd list-modules

设置systemdlog_level: /etc/systemd/daemon.log

查看进程的fd: ls -l /proc/xxx/fd

1、通过以下步骤进行测试: (1)执行 mv /usr/bin/pulseaudio /usr/bin/pulseaudiobak, 重启让pulseaudio无法自启动 (2)命令行 执行 arecord -Dhw:0,1 -d 10 -f cd -t wav test.wav通过alsa进行录音(hw:0,1为指定录音的设备,arecord命令的使用可以参考网上资料) (3) 将生成的test.wav用audacity软件进行播放,查看是否有杂音。 此时依旧有杂音,基本可以确定是送上来的数据流有问题(中间音频驱动和alsa编解码的过程因为编解码过程都比较完善,一般不会出现问题) 2、此问题从现象上看就是将录制的音量提高到50%的时候,通过alsamixer查看此时Internal Mic boost开始有增强效果,导致噪音被放大。此问题在软件方面只能通过修改配置文件将Internal Mic boost设置为ignore来取消增强效果来减缓此问题,要根本解决还需要厂商进行适配。 https://blog.csdn.net/xiongtiancheng/article/details/80577478

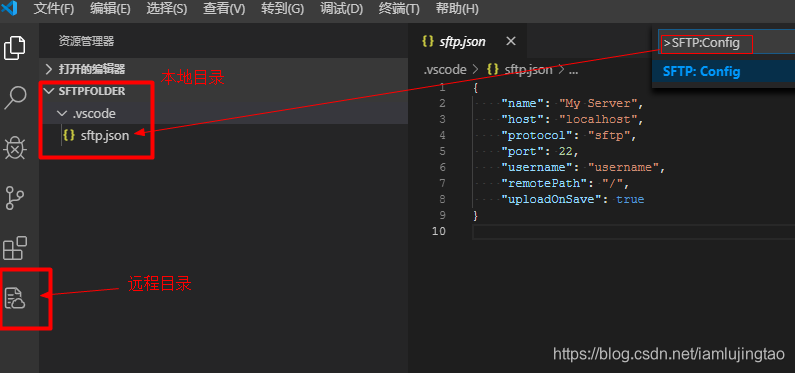

SFTP vscode 设置

现在我们本地和远程均有一个文件夹“sftpFolder”,用VsCode打开本地文件夹“sftpFolder”,然后执行

ctrl+shift+p ,搜索 SFTP:Config

,回车后,会生成一个“.vscode/sftp.json”,这个就是配置文件。

同时,如下图左侧会多了一个“远程目录”。

1 | { |

pip环境的转移和复制

python项目中一般都包含一个 requirements.txt 文件,用于记录所有依赖包及其精确的版本号。以便新环境的部署。

下面为在linux环境下“pip自动生成和安装requirements.txt”的步骤。

激活相应虚拟环境 conda env list # 查看所有的conda虚拟环境 source activate env_name 1 2 生成requirements.txt文件 pip freeze > requirements.txt 1 安装requirements.txt依赖 conda create -n env_name python=3.6 # 创建新的虚拟环境 source activate env_name # 激活新建的虚拟环境 pip install -r requirements.txt

conda环境的转移和复制

conda导出已有环境,环境会被保存在environment.yaml文件中。 conda env export > environment.yaml 1 当我们想再次创建该环境,或根据别人提供的.yaml文件复现环境时,就可以通过下面的命令来复现安装环境了。 conda env create -f environment.yaml 1 注:.yaml文件移植过来的环境只是安装了你原来环境里用conda install等命令直接安装的包,你用pip之类装的东西没有移植过来,需要你重新安装。

tensorboard

1 | tensorboard --logdir logs |

查看谁执行了某条命令:

重现bug,然后检查日志,sudo journalctl -b0 |grep SYSCALL 能看到有 date 命令调用 syscall 112 号 设置了系统时间。

sudo mv /usr/bin/date /usr/bin/date.real

编写文件 /usr/bin/date

1 |

|

执行命令 sudo chmod +x /usr/bin/date

然后按照步骤重现bug,然后立即查看 /tmp/log 文件的内容。

比如看到文件底部有 pid: 12345, 然后去本文件上方找到 12345,看它的父进程是什么,我看到了一个父进程 AlarmThread,pid 为 3203。

然后切换到 root 用户,执行命令

1 |

|

看到结果是 AlarmThread 和 /opt/apps/cn.com.topsec.topdesk/files/bin/TDATX0,这就说明了是 cn.com.topsec.topdesk 软件包里的程序调用了 date 命令设置了时间。

quilt配置:

for where in ./ ../ ../../ ../../../ ../../../../ ../../../../../; do

if [ -e

wpa_cli:

wpa_cli -i wlan0 scan scan_results nmcli con show nmcli dev wifi connect ASXXX 查看连接情况wpa_cli -i wlan0 scan_results | grep ASXXX

查看电脑支不支持wpa:

gdb wpa 在这个函数里, wpa_supplicant_set_suites

然后p一下这个值。

wpa_s->drv_flags

gdb 他的电脑。

删除已连接的网络:

rm /etc/NetworkManager/systemd-connections/*** systemctl restart network-manager.service

跟踪signal_fd:

sudo trace-bpfcc -tK 'do_send_sig_info(int sig, struct siginfo info, struct task_struct p) "sig=%d,recv_pid=%d,send_pid=%d", sig,p->pid,info->si_pid'

trace-bpfcc指定头文件:加-I

trace-bpfcc: sudo trace-bpfcc -t 'do_filp_open(int dfd, struct filename *pathname) "name=%s", pathname->name' | grep "/dev/rtc"

sudo trace-bpfcc -tK 'btrfs_mount_root(void* f, int flags, char* name) "flags=0x%lx name=%s", flags, name'

sudo trace-bpfcc -t 'group_send_sig_info(int sig, void info, struct task_struct p)"sig=%d, task_pid=%d, task_name=%s",sig, p->pid, p->comm' >> 1.log

sudo dbus-monitor --system interface=org.freedesktop.login1.Manager path=/org/freedesktop/login1

316 trace-bpfcc -t 'generic_file_direct_write(struct kiocb *iocb) "func=0x%lx", iocb->ki_filp->f_mapping->a_ops->direct_IO' -p 28942

sudo trace-bpfcc -t 'group_send_sig_info(int sig, void info, struct task_struct p)"sig=%d, task_pid=%d, task_name=%s",sig, p->pid, p->comm' >> 1.log

mac os微信双开方法

open -n /Applications/WeChat.app/Contents/MacOS/WeChat

查找被隐藏的进程

1 | sysdig -c topprocs_cpu # 该命令可以输出cpu占用的排行,经测试可以显示出被隐藏的进程 |

以上两个命令需要额外安装,不是系统自带命令

1 | sysdig可用如下命令安装,curl是类似wget的下载命令,这里下载的是一个bash脚本,下载后再通过bash执行安装 |

1 | 挖矿病毒都会有定时的网络发送信息,所以可用如下命令查看在病毒运行期间,是否存在异常IP地址 |

/proc/目录

/proc/pid/cmdline 进程启动命令 /proc/pid/cwd 链接到进程当前工作目录 /proc/pid/environ 进程环境变量列表 /proc/pid/exe 链接到进程的执行命令文件 /proc/pid/fd 包含进程相关的所有的文件描述符 /proc/pid/maps 与进程相关的内存映射信息 /proc/pid/mem 指代进程持有的内存,不可读 /proc/pid/root 链接到进程的根目录 /proc/pid/stat 进程的状态 /proc/pid/statm 进程使用的内存的状态 /proc/pid/status 进程状态信息,比stat/statm更具可读性 /proc/self 链接到当前正在运行的进程

配置ssh免密登录

1 | ssh-keygen -t rsa -b 4096 |

自动把公钥复制到虚拟机

1 | ssh-copy-id ubuntu@192.168.105.10) |

ssh设置别名

vim编辑~/.ssh/config文件

1 | Host jhd |

SSH config

作者:Pavinberg 链接:https://zhuanlan.zhihu.com/p/716963359 来源:知乎 著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

SSH config 作用就是可以把 SSH 相关的信息都记录到一个配置文件,可以简化操作、节约时间。

SSH config

有一个系统级的,一个用户级的。一般普通用户只关注用户级的。文件路径为

~/.ssh/config 。

基本写法

一般一个服务器写成一小段,形如:

1 | Host Server1 |

这段的含义为有一个服务器:

- 我们为它起了个名字叫 Server1

- 它的 IP 是 172.16.0.1(也可以填 Hostname)

- 我在上面的用户名是 zhangsan

- SSH 服务监听端口号为 22(即默认值,也可以不写这一行)

- ServerAliveInterval 180 表示在建立连接后,每 180 秒客户端会向服务器发送一个心跳,避免用户长时间没操作连接中断

- 最后一行表示使用一个专用的密钥,如果没有专用的密钥则删除该行即可。

登录这台服务器的话,输入:

1 | ssh Server1 |

拷贝文件(反过来就是从服务器往本地下载文件):

1 | scp /path/to/local/file Server1:/path/to/remote/ |

可以看到,这样的好处有:(1)简洁,不需要记忆 IP 地址、端口号。(2)可以保持连接。

配置免密也相同,输入以下命令并输入密码:

1 | ssh-copy-id Server1 |

通配符

如果有一批服务器都是相同的配置,更是可以用通配符统一处理:

1 | Host Server* |

相信读者已经猜到其中的含义。第一段表示所有名字为 Server 开头的服务器,他们的用户名都是 zhangsan,端口都是 22,同时都有保持连接的心跳。然后下面列了 3 台服务器,我们只需要指定它们的 IP 地址。

多文件管理

如果需要管理非常多的服务器,全写到一个文件里会很乱很难维护,也不方便共享。事实上,~/.ssh/config

中支持引用其它文件。我一般习惯新建一个这样的配置

~/.ssh/config-cluster-shanghai,在其中编写类似上文的内容。然后在

~/.ssh/config 的开头加入如下一行即可:

1 | Include config-cluster-shanghai |

事实上这里也可以用通配符,比如:

1 | Include config-* |

这样 ~/.ssh/ 目录下的所有 config-

开头的文件都会被引用到。

跳板

很多集群需要跳板机才可登录,我们需要先登录跳板机,再从跳板机登录内部机器。这会引入两个麻烦,一是登录要两次,如果配置 SSH config 还需要在跳板机也配置一份儿;二是拷贝文件十分麻烦,要拷贝两次。

对此可以这样写配置:

1 | Host Jumper |

第一段为跳板机的登录方式,第二段中新增了一个 ProxyJump 字段,表示所有 Server 开头的服务器,在登录的时候都要从 Jumper 这个服务器跳转一下。这时候我们想登录 172.16.0.1,只需要直接输入:

1 | ssh Server1 |

注意一个细节是,这种配置下我们是直接从本地登录内部服务器,所以在配置免密时,是需要把本地的公钥放到内部服务器的。

SCP 服务器间拷贝文件

scp 的基本用法相信大家都会,上文也多次提到。但如果想在两台服务器之间拷贝文件,事实上是可以在本地执行 scp 的:

1 | $ scp Server1:/path/to/file Server2:/path/to/file2 |

这个命令要求 Server1 可以直接访问

Server2。如果不满足这个条件,可以用本机转发,只需要增加一个参数

-3 表示用本地机器当转发机:

1 | $ scp -3 Server1:/path/to/file Server2:/path/to/file2 |

批量操作 PSSH

如果有一组机器要做相同的操作,可以使用 PSSH 工具。

很遗憾的是,这个工具原作者已经不维护了,但 GitHub 上散落着原仓库的副本,同时也有大家新增的逻辑。

安装:

1 | $ python3 -m pip install pssh |

准备一个 iplist:

1 | $ cat iplist |

批量操作:

1 | pssh -ih iplist echo Hello |

-i 表示把 stdout

输出,否则只会显示命令执行是否成功。-h 表示 host

的列表,后接 iplist 这个文件名。pssh 默认会在命令超时后强制结束,

不希望超时,可以加一个 -t 0 表示超时时间为 0 秒,0

表示无穷大。

PSSH 也可以把每个服务器的结果输出到不同的目录、可以单独指定 Host 等等,大家可以参考 manpage:

1 | $ man pssh |

禁用root ssh登录

1 | 一方面是ssh远程登录没有禁用root的远程登录,此时需要在/etc/ssh/sshd_config中添加 |

有条件的可以将服务器中ssh登录都设置为rsa免密登录,这样可以避免绝大多数问题

一般是通过尝试用户名和密码对服务器进行攻击,但是每台服务器中用户名都不同,所以很难攻击,但是root名称一般不会变,所以一般是先攻击这个名称。

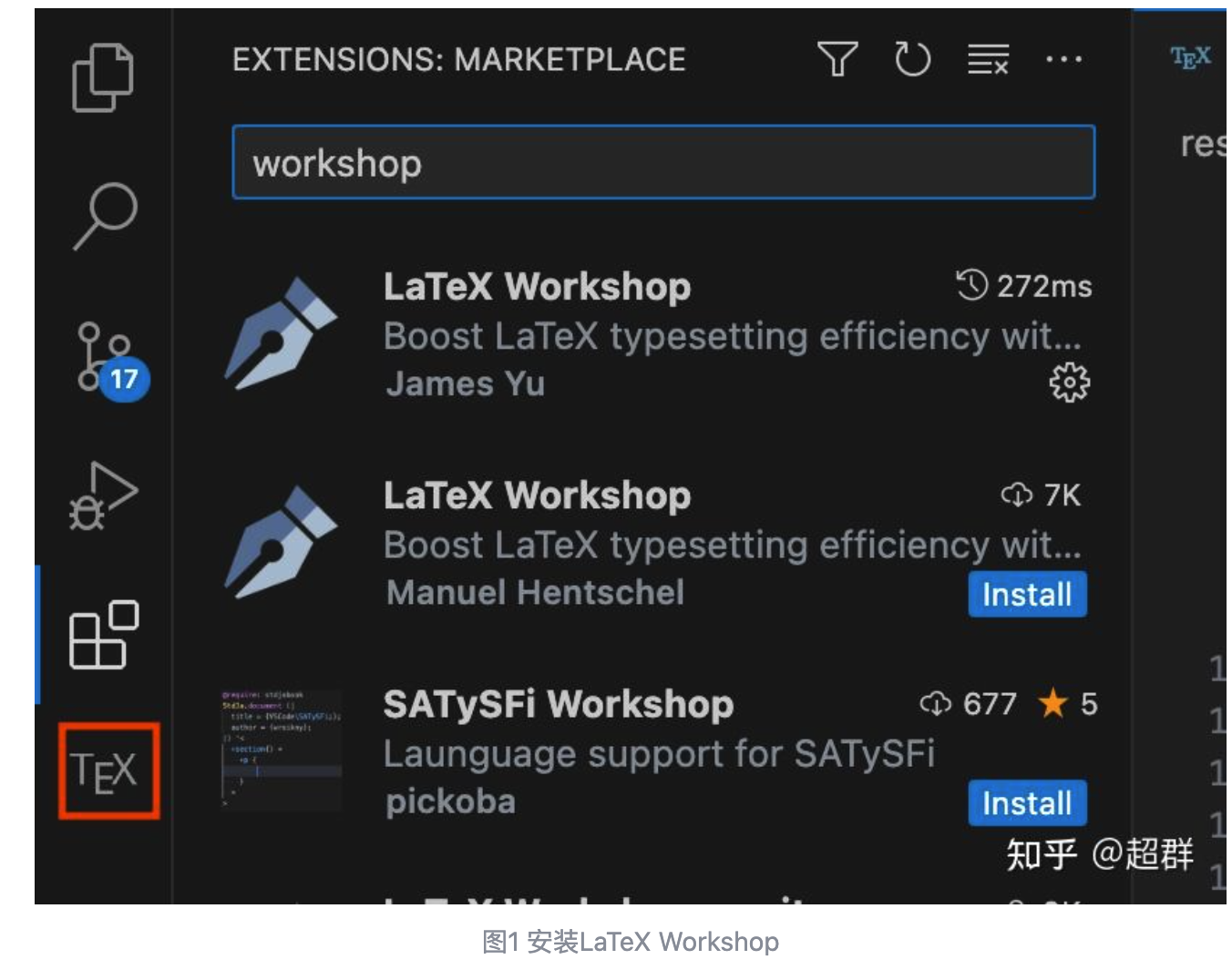

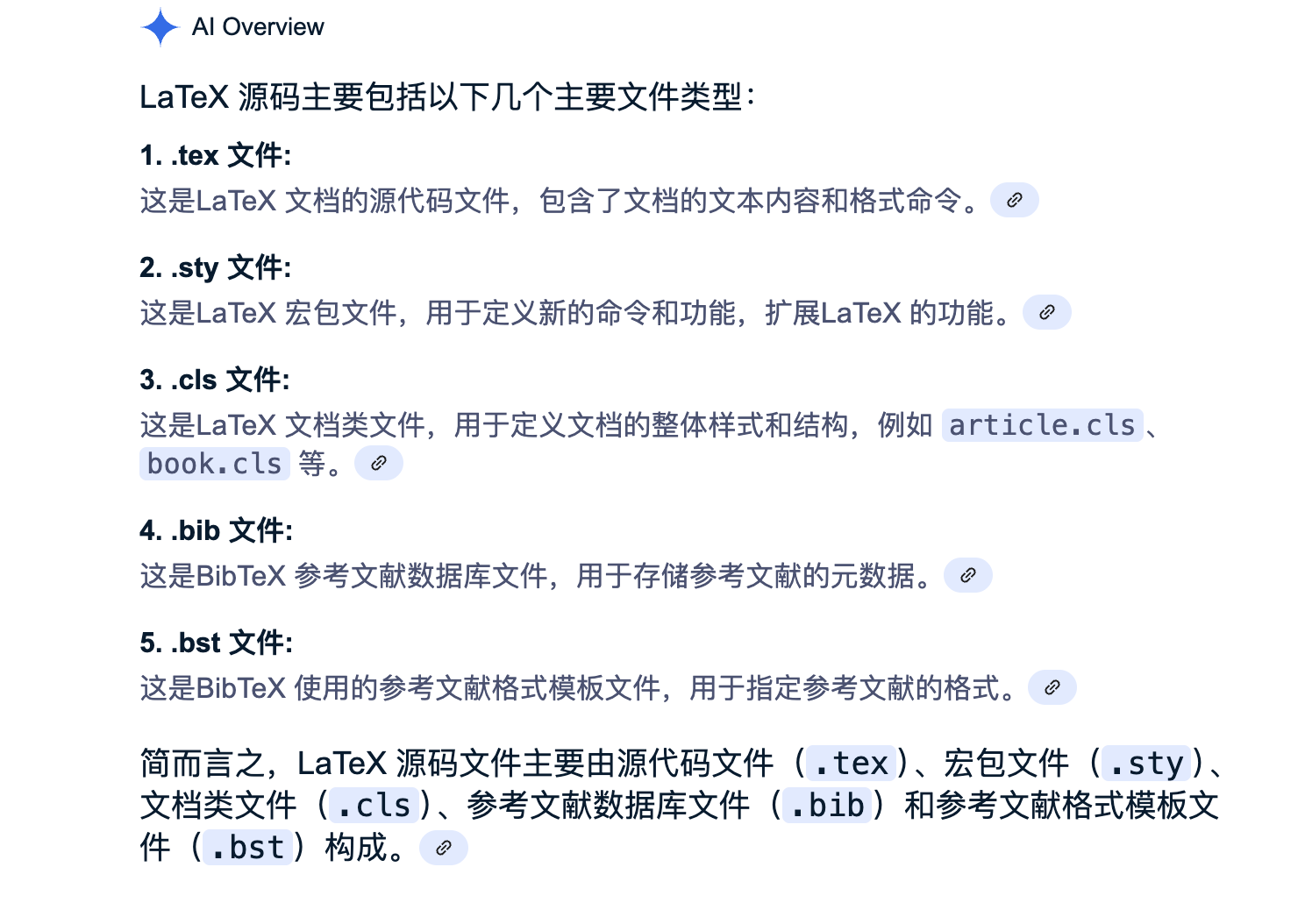

vscode latex使用教程

1. 下载Visual Studio Code

Visual Studio Code (VScode)是一款集成开发环境(Integrated Development Environment,简称IDE) 。通过安装第三方扩展 LaTeX Workshop ,VScode能够用于latex源文件管理与编辑。

打开下载好的 VSCode ,鼠标点击左边栏中的扩展/Extensions,在搜索框中输入workshop,安装James Yu的 LaTeX Workshop (点击Install即可安装)。安装好之后,打开latex源文件夹,即可看到红色框中的TEX标识,如下图所示。

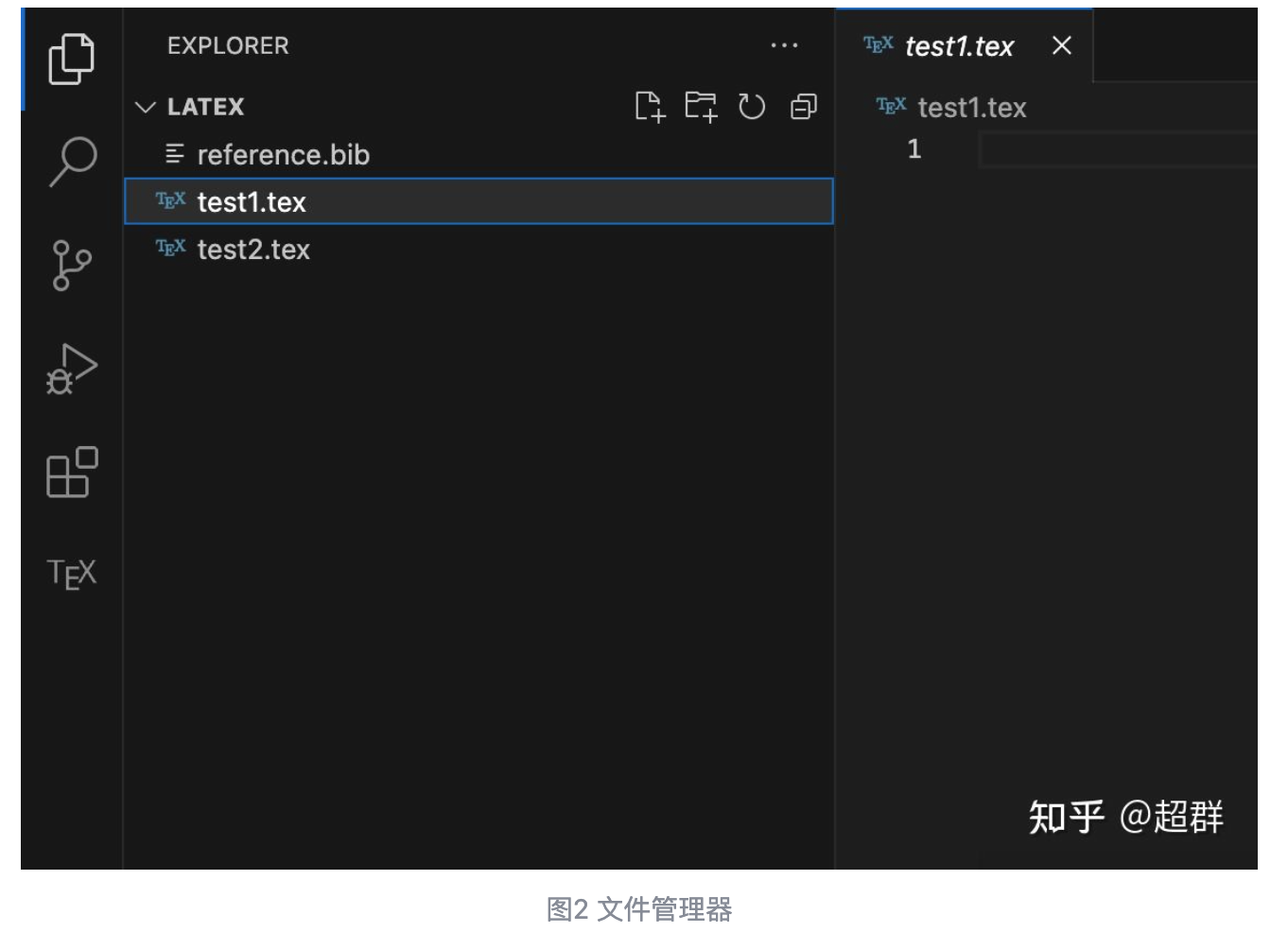

通过点击左边栏管理器/Explorer,可以显示/隐藏文件管理器;在文件管理器中.tex文件是latex源文件,.bib文件是文献存储文件,如下图所示。

2. 下载MacTex

https://tug.org/mactex/mactex-download.html

MacTex是排版引擎Latex针对macOS系统的发型版,包含与TEX系统相关的各种程序、编辑与查看工具、常用宏包及文档、常用字体及多国语言支持。MacTeX相当于远处的水源,VScode则相当于水管,我们需要将水管与水源进行连接,才能从水管获取水源。因此,下载并安装MacTeX后,需要对VScode进行配置——水管与水源连接,才能编译.tex文件生成pdf文稿——获取水源。

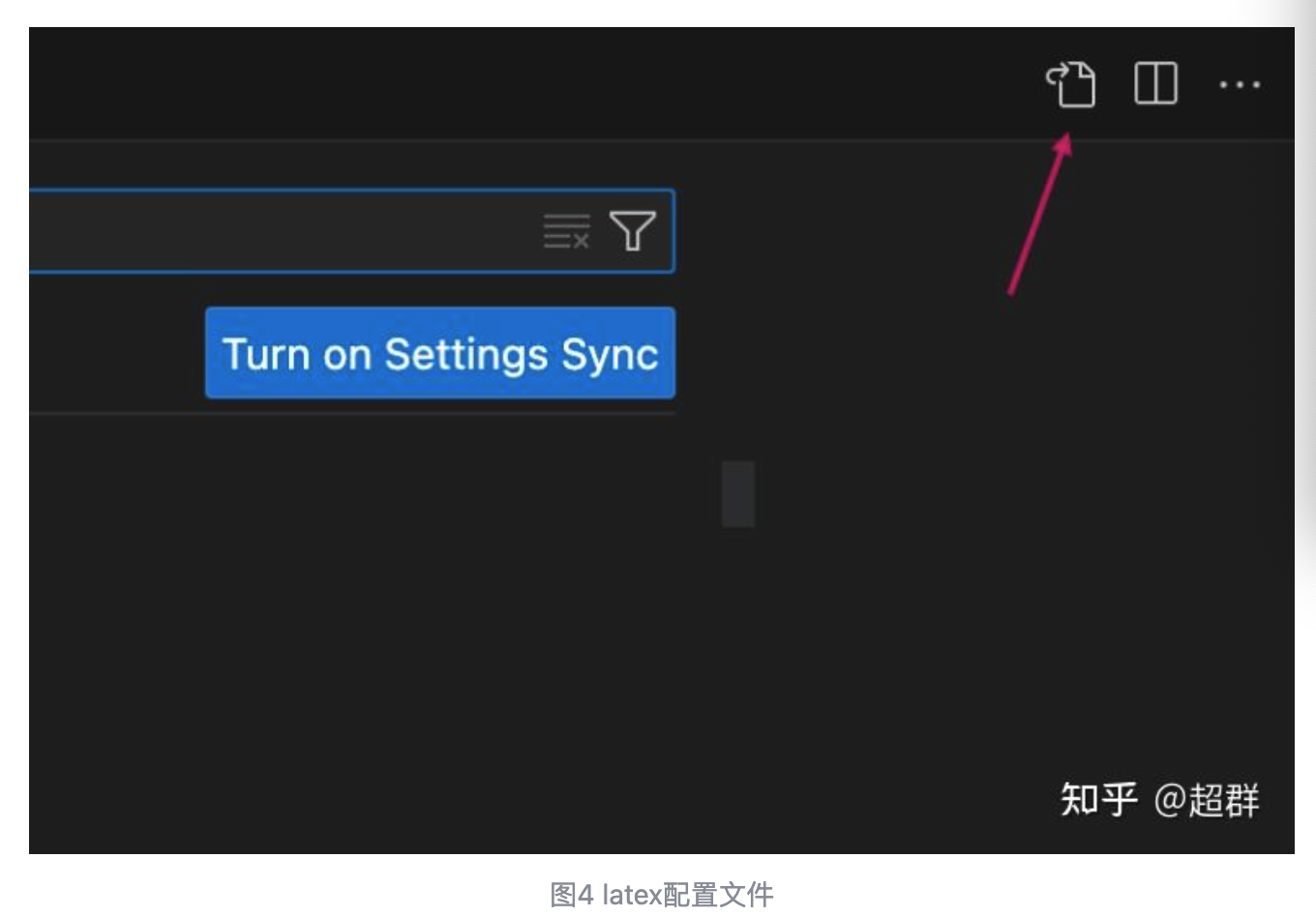

选择Settings,在弹出的界面右上角,点击Open Settings图标,即红色箭头所指向,如下图所示。

3. VScode的latex配置

(1)打开配置文件

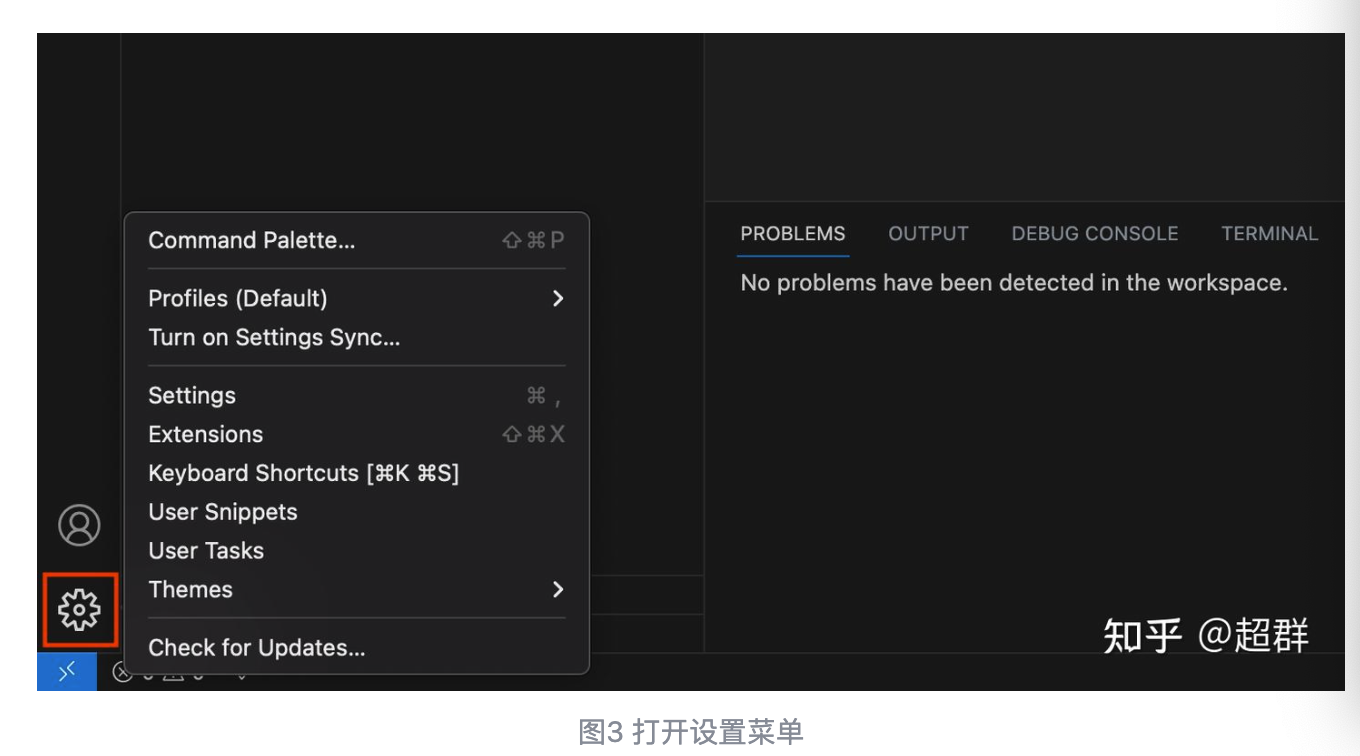

鼠标点击左下角⚙️(即红色框中齿轮图标),弹出菜单,如下图所示。

此时,settings.json文件将被打开,如下图所示。

(2)配置文件内容

1 | { |

(3)设置编译快捷键

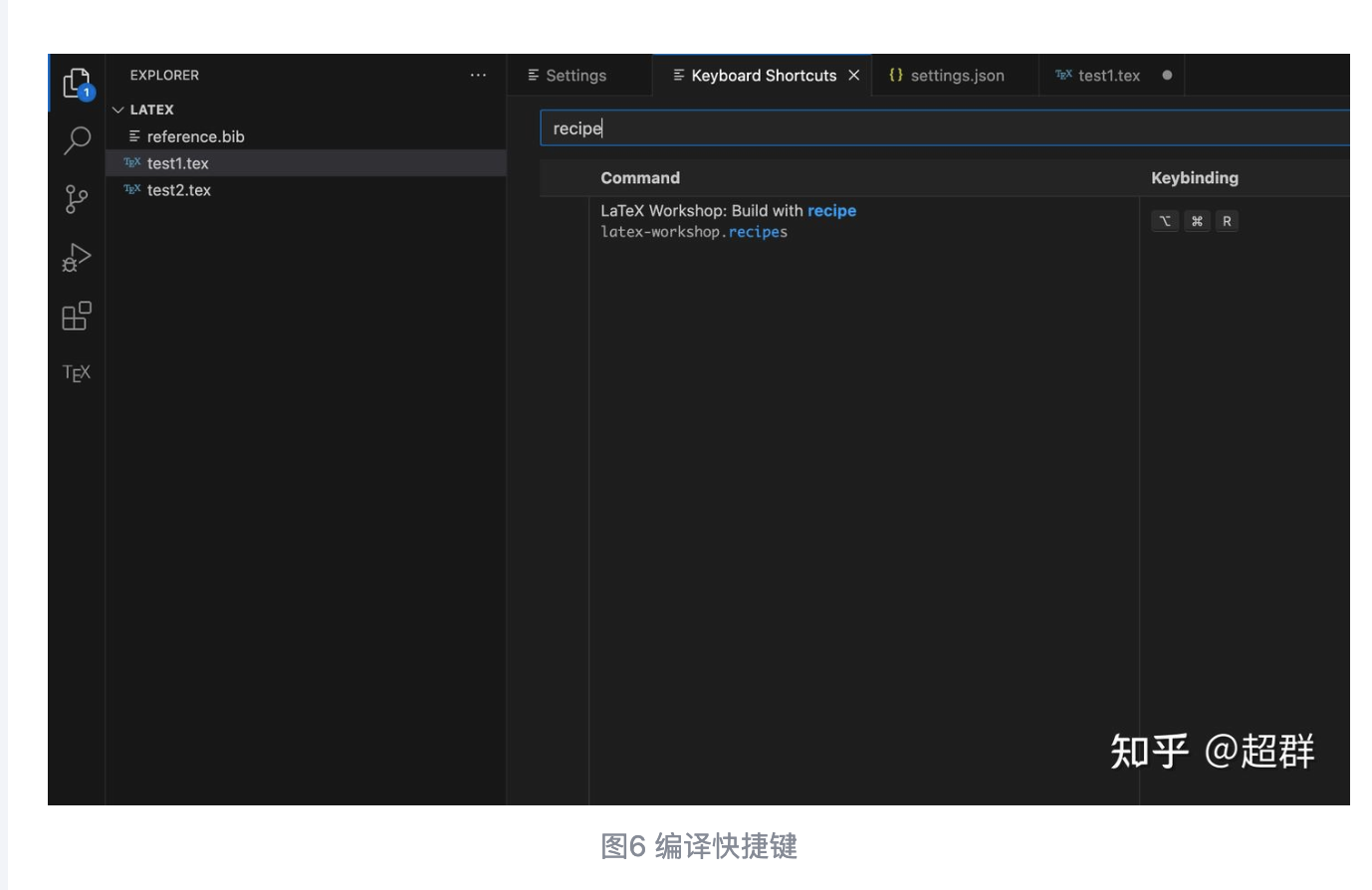

鼠标点击左下角齿轮,选择Keyboard Shortcuts,在弹出的界面搜索栏中输入recipe,如下图所示。双击检索到的快捷键修改栏,同时按下option+command+R,编译快捷键则设置完成。

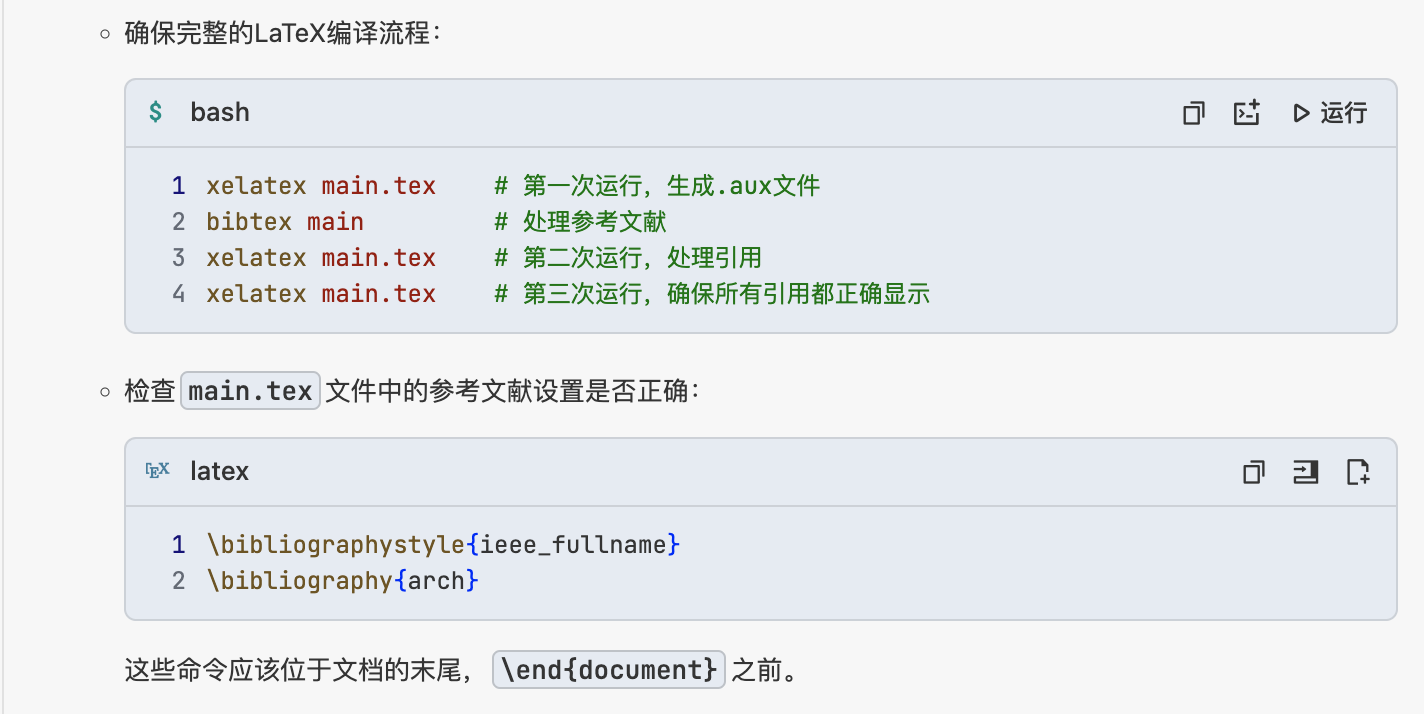

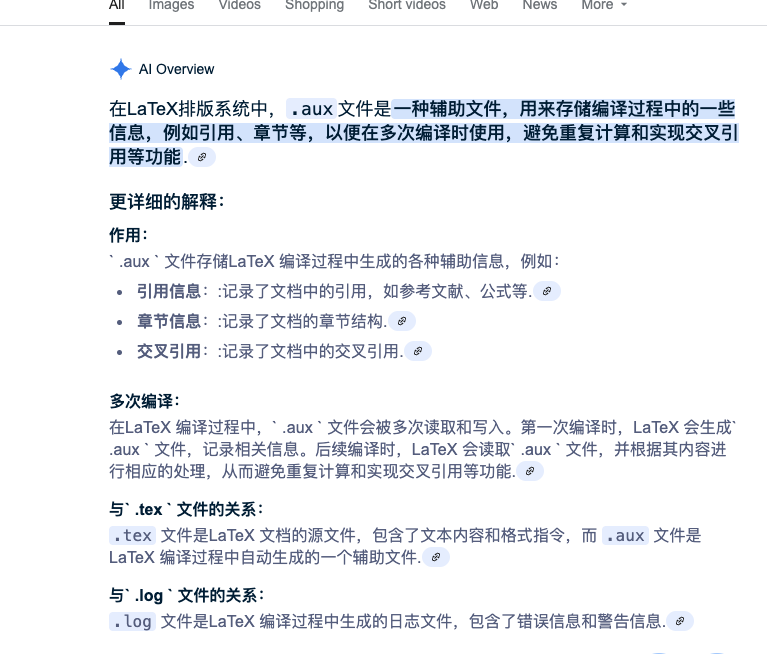

.aux

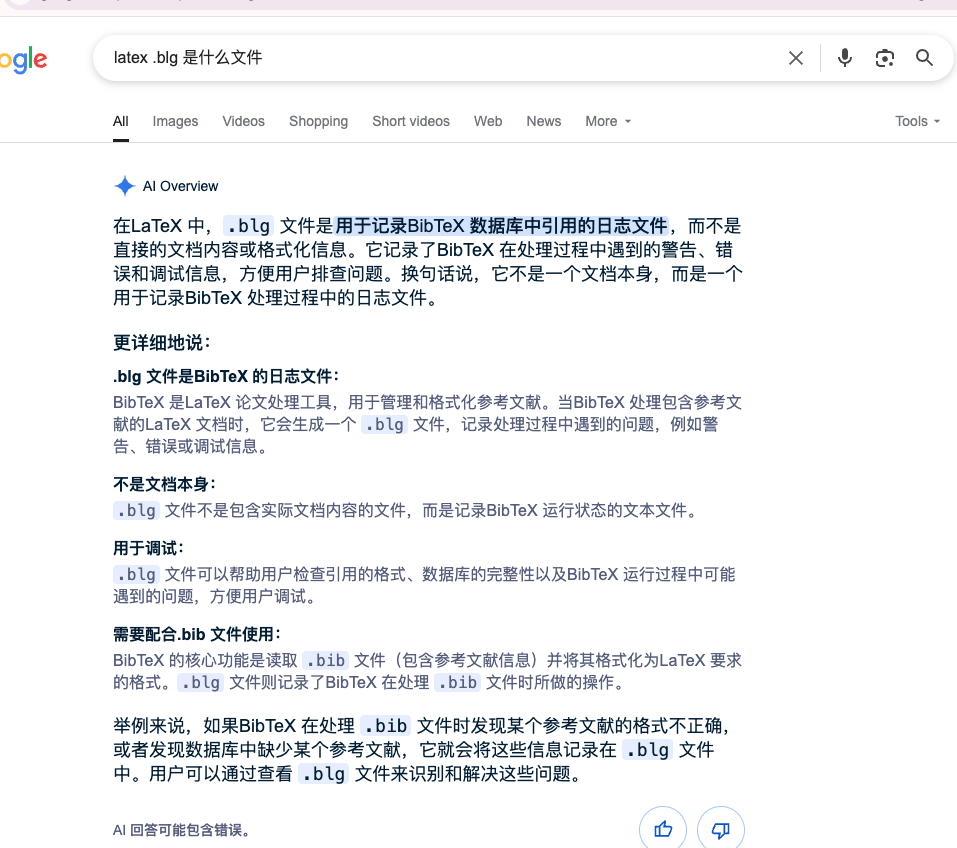

.blg

pnpm和npm以及yarn

pnpm和npm的区别是什么?

pnpm 和 npm 有以下一些区别:

- 安装方式和存储结构:npm 会将依赖包安装到项目中的 node_modules 文件夹中,它为每个依赖包创建一个软链接指向该文件夹,可能存在大量软链接导致存储占用较大;而 pnpm 将依赖包安装到.pnpm 文件夹中,使用硬链接将依赖包链接到项目中,这样可以减少存储占用和安装时间。

- 安装速度:npm 每个项目都需要安装和下载依赖包,速度相对较慢;pnpm 使用硬链接,相同的依赖包可以被多个项目共享,能够更快地安装依赖包,在大多数场景下其安装速度比 npm 快 2-3 倍。

- 依赖管理:npm 采用嵌套或扁平化的依赖管理方式,可能存在幽灵依赖(未在 package.json 中定义但项目中可引用的依赖)和依赖分身(同一依赖的不同版本被重复安装)等问题;pnpm 引入了内容寻址存储策略,只有直接依赖会平铺在 node_modules 下,子依赖不会被提升,解决了幽灵依赖问题,且相同的依赖只会在全局 store 中安装一次,避免了依赖分身,其创建的 node_modules 是非扁平化结构。

- 兼容性:npm 是默认的 JavaScript 包管理器,广泛使用于大多数项目;pnpm 是新兴的包管理工具,可以与 npm 兼容,并与多个 npm 生态系统工具协同工作,但可能存在与一些 npm 插件和工具的不兼容问题。

- 磁盘空间利用:使用 npm/yarn 时,如果多个项目都依赖同一个包,该包可能会被多次安装,磁盘中存在多个相同代码的副本;而 pnpm 内部使用基于内容寻址的文件系统,不会重复安装同一个包,对于同一个包的不同版本,也会极大程度地复用之前版本的代码,能更高效地利用磁盘空间。

pnpm

pnpm 是一个快速、节省磁盘空间的包管理工具。

它具有以下一些特点和优势:

- 高效的磁盘空间利用:通过硬链接和内容寻址存储,避免了多个项目中重复安装相同依赖的冗余存储。

- 快速的安装速度:得益于其优化的依赖处理机制。

例如,当您有多个使用相同依赖版本的项目时,pnpm

可以共享这些依赖,而不是每个项目都单独安装一份。

安装pnpm

npm install -g pnpm

pnpm安装依赖

1 | pnpm install |

执行 pnpm install时,它会读取项目根目录下的

package.json文件来配置依赖包列表。

package.json是一个 JSON

格式的文件,用于描述项目的相关信息,包括项目名称、版本、描述以及项目所依赖的其他包及其版本等。

pnpm使用一个称为

pnpm-lock.yaml的文件来记录项目的依赖关系和版本,类似于

npm的

package-lock.json文件,它可以确保项目在不同环境中得到相同的依赖版本。

当执行 pnpm install命令时,如果存在

pnpm-lock.yaml文件,并且其中记录的依赖版本与

package.json中指定的兼容,pnpm将根据

pnpm-lock.yaml安装确切的依赖版本。如果

pnpm-lock.yaml不存在或与

package.json不兼容,pnpm将重新生成

pnpm-lock.yaml文件,并根据

package.json中的依赖信息安装相应的包。

在 macOS 系统中,执行 pnpm install

后,依赖包的默认安装位置是用户主目录下的 .pnpm 文件夹。

不过,你可以通过配置来修改依赖包的安装路径。例如,使用以下命令可以设置全局安装包的 bin 文件的目标目录、包元数据缓存的位置等:

1 | pnpm config set global-bin-dir "你期望的全局 bin 文件目录" |

需注意,修改安装路径后,需要重新打开终端以使更改生效。

另外,pnpm 还会创建一个 pnpm-lock.yaml

文件来记录项目的依赖关系和版本。这个文件类似于 npm 的

package-lock.json,用于确保在不同环境中能够安装相同版本的依赖包。

如果你在安装过程中遇到问题或需要更详细的信息,可以参考pnpm 的官方文档。

或者,你也可以参考如下步骤进行配置(假设你想将相关文件安装到“/users/xxx/my_pnpm”目录下):

- 终端运行

pnpmsetup命令; - 找到用户的主目录下的

.zshrc文件(注意:该文件默认隐藏,可以用cmd+shift+.查看),初始内容可能类似于:

1 | export pnpm_home="/users/xxx/library/pnpm" |

在原来的基础上文件底部加上:

1 | export path="/users/xxx/my_pnpm/bin:$path" |

(请将“xxx”替换为自己的用户主目录)

- 终端运行

source ~/.zshrc命令,就可以使用pnpm安装的全局依赖啦。

pnpm tauri dev

“pnpm tauri dev”的作用是启动 Tauri 应用的开发模式。

Tauri 是一个基于 Rust 实现的跨端桌面应用开发工具,应用的界面可以使用前端技术进行开发,如原生的 HTML、CSS、JS,或者使用 React、Vue 等前端框架。

执行“pnpm tauri dev”命令后,它首先会执行“pnpm dev”,启动一个 Vite 脚手架来运行前端页面。经过一段时间的编译(大概 3 分钟左右),Rust 后端程序也会启动,随后会自动弹出 Tauri 应用。

在实际使用中,为了更方便开发,可以在“package.json”的“scripts”里加入一行

"tauri:dev":"tauri dev",之后就可以使用

pnpm run tauri:dev来启动开发窗口。

该命令中的“tauri dev”具体做的事情可能包括启动 Tauri 应用的后端服务、监测项目中的文件变化并自动重新编译和加载等,以便开发者能够实时看到代码修改后的效果,方便进行前端界面和 Rust 后端逻辑的开发调试工作。

b

如果需要打包后进行调试,请在以下命令后面加上 --debug

“pnpm tauri build”命令用于构建 Tauri 应用。它会将你的前端资源(如 HTML、CSS、JavaScript 等)与 Rust 代码一起嵌入到一个单独的二进制文件中。

第一次运行该命令时,需要一些时间来收集 Rust 包并构建所有内容,但在随后的运行中,它只需重新构建应用程序代码,速度会快很多。

二进制文件本身将位于

src-tauri/target/release/(应用程序名称),而安装程序将位于

src-tauri/target/release/bundle/。

然而,在新创建的项目中第一次打包时,可能会报“error: you must change the bundle identifier in tauri.conf.json > tauri > bundle > identifier. the default value com.tauri.dev is not allowed as it must be unique across applications.”错误。这是因为第一次打包需要修改

src-tauri/tauri.conf.json

文件里的配置项“identifier”,将其值由“com.tauri.dev”改成“com.tauri.build”,然后再运行打包命令。

如果你需要为特定的操作系统或架构进行构建,例如 32 位或

arm64,可以添加相应的 --target 标志。例如,要编译 32 位

Windows 应用,可以使用

tauri build --target i686-pc-windows-msvc;要编译 arm64

应用,需要先安装额外的构建工具(如在 Visual Studio Installer 中安装“C++

arm64 构建工具”),然后使用

rustup target add aarch64-pc-windows-msvc 添加目标,并执行

tauri build --target aarch64-pc-windows-msvc --bundle nsis(注意,只有

nsis 目标支持 arm64 目标,且安装程序本身仍是 x86 的,将在 arm

机器上通过模拟运行,而应用本身是原生的 arm64 二进制)。

对于其他操作系统的详细构建信息和注意事项,可以参考 Tauri 的官方文档(https://tauri.app/ )以获取更准确和最新的指导。

pnpm命令:

1 | pnpm store path #查看 pnpm 整体的缓存路径 |

1 | pnpm store prune #清理 pnpm 的缓存 |

tauri

tauri init 命令(或者说npm run tauri init)将生成

src-tauri 文件夹。 传统上,Tauri

应用会将其核心相关的文件放置于此文件夹中。

让我们快速过一下此文件夹中的内容:

Cargo.tomlCargo 的清单文件。 您可以声明您应用所依赖的 Rust 包和应用的元数据等等。 要查看所有可修改的值,请参阅 Cargo 清单格式。tauri.conf.json此文件可让您自定义 Tauri 应用的各方各面,包括应用名称到允许的 API 列表。 请参阅 Tauri 的 API 配置来深入了解每个支持的选项。src/main.rs这是你的 Rust 程序的入口,也是我们启动 Tauri 的地方。 您可以发现它由两个部分组成: src/main.rs1

2

3

4

5

6

7

fnmain(){

tauri::Builder::default()

.run(tauri::generate_context!())

.expect("error while running tauri application");

}The line beginning with the

cfg! 宏所开始的一行仅有一个目的:关闭构建好的应用在 Windows 上运行时一般会出现的控制台窗口。 若您是 Windows 用户,您可以试试去掉这行看看会发生什么。main函数是您程序的入口点,也是运行时调用的第一个函数。icons您可能想为自己的应用整一个漂亮的图标! 为了帮助您快速开发,我们为您提供了一套默认图标。 您应该在发布前把这些图标换成您自己的图标。 您可以在 Tauri 的图标功能指南中了解有关多种图标格式的信息。

就是这样! 现在您可以在您的终端中运行接下来的命令来开始您的应用程序的开发构建:

1 | npm run tauri dev |

应用预览

npm

npm 即 Node Package Manager ,是 Node.js

的默认包管理工具。

它允许开发者轻松地安装、共享、分发和管理代码模块(包)。

npm 拥有庞大的包仓库,涵盖了各种各样的功能和库。

例如,您可以使用 npm install express 命令来安装

Express 这个用于创建 Web 应用的框架。

许多前端和后端的项目都依赖 npm

来管理项目所需的各种依赖包,以提高开发效率和代码的可维护性。

如何解决npm ERR! request to https://registry.npm.taobao.org/pnpm failed, reason: certificate has expired

原因:需注意原淘宝 npm 镜像站的域名(https://registry.npm.taobao.org)已不再使用,于 2022 年 05 月 31 日零时起停止服务

解决方法:

1 | npm config set registry https://registry.npmmirror.com |

npm cache clean --force清理的是哪里的缓存?

npm cache clean --force 清理的是 npm 本地缓存。

在大多数系统中,npm 缓存默认存储在以下路径:

- Windows:%appdata%-cache

- macOS 和 Linux:~/.npm

使用该命令会强制删除所有已有的缓存文件,包括已下载的依赖包和相关数据等。

需要注意的是,执行此操作后,npm 将需要重新下载所有依赖,这可能会增加安装时间。因此,在执行该命令之前,需确保了解其后果,并且确实需要清理缓存。例如,当怀疑缓存中的包损坏或过时,导致安装问题;或者需要确保安装的是包的最新版本;又或者缓存占用了大量磁盘空间时,可以考虑使用该命令。

另外,如果只是想查看 npm 缓存的位置,可以使用命令

npm cache dir或者 npm config list --json。对于

yarn,可以使用命令 yarn cache dir查看缓存位置。

npm fund

npm fund是 npm

包管理工具中的一个命令。它的作用是列出项目中正在寻找资金的依赖包及其对应的捐赠平台和链接。

当运行 npm install安装依赖包后,使用

npm fund命令可以查看相关信息。在

package.json文件中,维护者可以添加一个“funding”字段,用于指定捐赠平台的元数据和链接,如

patreon、opencollective、github sponsors、licensezero或其他支付网站的

url。

运行

npm fund后,它会在用户的默认浏览器中打开指定的捐赠服务链接,以便进行信用卡捐赠等操作。

例如,运行 npm fund可能会得到类似以下的输出:

1 | package-name@version |

这表示 package-name这个包及其依赖项

dependency1和

dependency2正在寻找资金支持,dependency1的捐赠平台是

opencollective,链接为

https://opencollective.com/dependency1;dependency2的捐赠平台是

github sponsors,链接为

https://github.com/sponsors/dependency2。

通过

npm fund命令,用户可以了解到所使用的开源包是否接受捐赠以及如何进行捐赠,以支持开源项目的发展。

需要注意的是,并非所有的包都会在

package.json中设置“funding”字段,只有那些明确声明了的包才会在

npm fund命令的输出中显示相关的捐赠信息。同时,捐赠是完全自愿的行为,用户可以根据自己的意愿和能力决定是否进行捐赠。

npm list

检查某个模块是否安装成功

1 | npm list hexo-filter-mathjax |

npm项目 package.json

scripts字段

scripts

字段是一个对象,用于定义各种可执行的脚本命令。

这些脚本命令可以通过在终端中运行

npm run <script_name> 来执行。

例如,如果 scripts 字段中有以下定义:

1 | "scripts": { |

那么,您可以在终端中使用 npm run start 来启动

node server.js ,使用 npm run build 来执行

webpack --config webpack.config.js 。

scripts 字段的主要用途包括:

- 定义项目的开发流程:比如启动开发服务器、进行代码编译、运行测试等。

- 简化复杂的命令:将一系列复杂的命令组合成一个简单易记的脚本名称。

- 保持命令的一致性:无论在哪个开发环境中,只要项目的

package.json相同,运行npm run <script_name>的效果就是一致的。 - 方便团队协作:团队成员可以通过相同的脚本命令进行项目的开发、构建和部署等操作。

总之,scripts

字段为项目提供了一种方便、可复用和标准化的方式来执行各种命令,提高了开发效率和项目的可维护性。

yarn

Yarn 是一个 JavaScript 包管理工具。

它的主要目的是为了提供更可靠、高效和安全的依赖管理体验。

Yarn 具有以下一些特点和优势:

1. 确定性:通过创建 yarn.lock

文件来锁定每个依赖项的版本,确保在不同的环境中安装的依赖版本一致,从而提高项目的可重复性。

2. 并行安装:能够同时下载多个依赖包,大大提高了安装速度。

3. 离线模式:一旦依赖被下载过,再次安装时,如果缓存中存在,就可以离线安装,无需重新从网络获取。

4. 安全检查:在安装依赖时,会对依赖包的完整性进行检查,确保其没有被篡改。

例如,当您在一个大型的前端项目中,使用 Yarn

可以快速、稳定地安装各种前端库和框架,如

React、Vue 等。同时,团队协作时,通过

yarn.lock

文件可以保证每个成员的开发环境中依赖版本的一致性。

webview

webview是什么?

WebView 是一个能在移动应用或桌面应用中嵌入网页内容的组件。

它允许开发者在原生应用的界面中直接显示网页,实现了原生应用和网页内容的融合。

WebView 的主要作用包括:

- 混合开发:通过在原生应用中嵌入 WebView,开发者可以将部分界面或功能以网页的形式实现,这样既能利用原生应用的性能和功能,又能借助网页开发的便捷性和快速迭代能力。

- 展示动态内容:比如新闻应用可以使用 WebView 来显示从服务器获取的实时新闻页面。

- 跨平台:在不同的平台(如 Android、iOS 等)上,WebView 提供了一种相对统一的方式来展示网页内容,有助于减少跨平台开发的差异。

- 节省开发成本:对于一些相对简单且经常变化的功能,使用 WebView 加载网页可以避免为每个平台单独开发原生代码。

例如,一些电商应用可能会在商品详情页面使用 WebView 来展示从服务器动态获取的商品介绍和评论,而应用的框架和核心功能则由原生代码实现。

不同的平台对 WebView 的实现和特性可能会有所不同,但总体功能和用途是相似的。在开发过程中,需要注意 WebView 的性能优化、缓存管理、与原生代码的交互等方面的问题。

Rust

cargo

Cargo 是 Rust 编程语言的包管理和构建工具。

它主要用于以下几个方面:

- 依赖管理:可以方便地声明项目所依赖的其他 Rust 库,并自动下载和管理它们的版本。

- 项目构建:处理项目的编译、链接等构建过程,支持多种编译选项和配置。

- 测试运行:能够轻松运行项目中的测试用例。

- 发布管理:帮助开发者将项目发布到 Rust 的包仓库(crates.io)。

使用 Cargo 可以极大地提高 Rust

项目开发的效率和便利性。

例如,当您创建一个新的 Rust 项目时,只需要运行

cargo new project_name 命令,Cargo

就会自动为您创建项目的基本结构,包括 Cargo.toml

配置文件(用于管理依赖和项目设置)和 src

目录(存放源代码)。

如果您想在项目中添加一个依赖库,只需要在 Cargo.toml

文件中添加相应的依赖信息,然后运行 cargo build

,Cargo 就会自动下载并集成该依赖库。

总之,Cargo 是 Rust 生态系统中不可或缺的一部分,为 Rust

开发者提供了强大而便捷的工具支持。

Cargo 功能

Cargo 除了创建工程以外还具备构建(build)工程、运行(run)工程等一系列功能,构建和运行分别对应以下命令:

cargo new <project-name>:创建一个新的 Rust 项目。cargo build:编译当前项目。cargo run:编译并运行当前项目。cargo check:检查当前项目的语法和类型错误。cargo test:运行当前项目的单元测试。cargo update:更新 Cargo.toml 中指定的依赖项到最新版本。cargo --help:查看 Cargo 的帮助信息。cargo publish:将 Rust 项目发布到 crates.io。cargo clean:清理构建过程中生成的临时文件和目录。- cargo clippy: 类似eslint,lint工具检查代码可以优化的地方

- cargo fmt: 类似go fmt,代码格式化

- cargo tree: 查看第三方库的版本和依赖关系

- cargo bench: 运行benchmark(基准测试,性能测试)

- cargo udeps(第三方): 检查项目中未使用的依赖

另外 cargo build/run --release 使用 release 编译会比默认的 debug 编译性能提升 10 倍以上,但是 release 缺点是编译速度较慢,而且不会显示 panic backtrace 的具体行号

创建一个最简单的rust项目

1 | cargo new greeting |

编译rust代码

1 | rustc runoob.rs # 编译 runoob.rs 文件 |

编译后会生成 runoob 可执行文件

Rust 输出文字的方式主要有两种:println!() 和 print!()

1 | println!("a is {}, a again is {}", a, a); |

在 VSCode 中配置 Rust 工程

Cargo 是一个不错的构建工具,如果使 VSCode 与它相配合那么 VSCode 将会是一个十分便捷的开发环境。

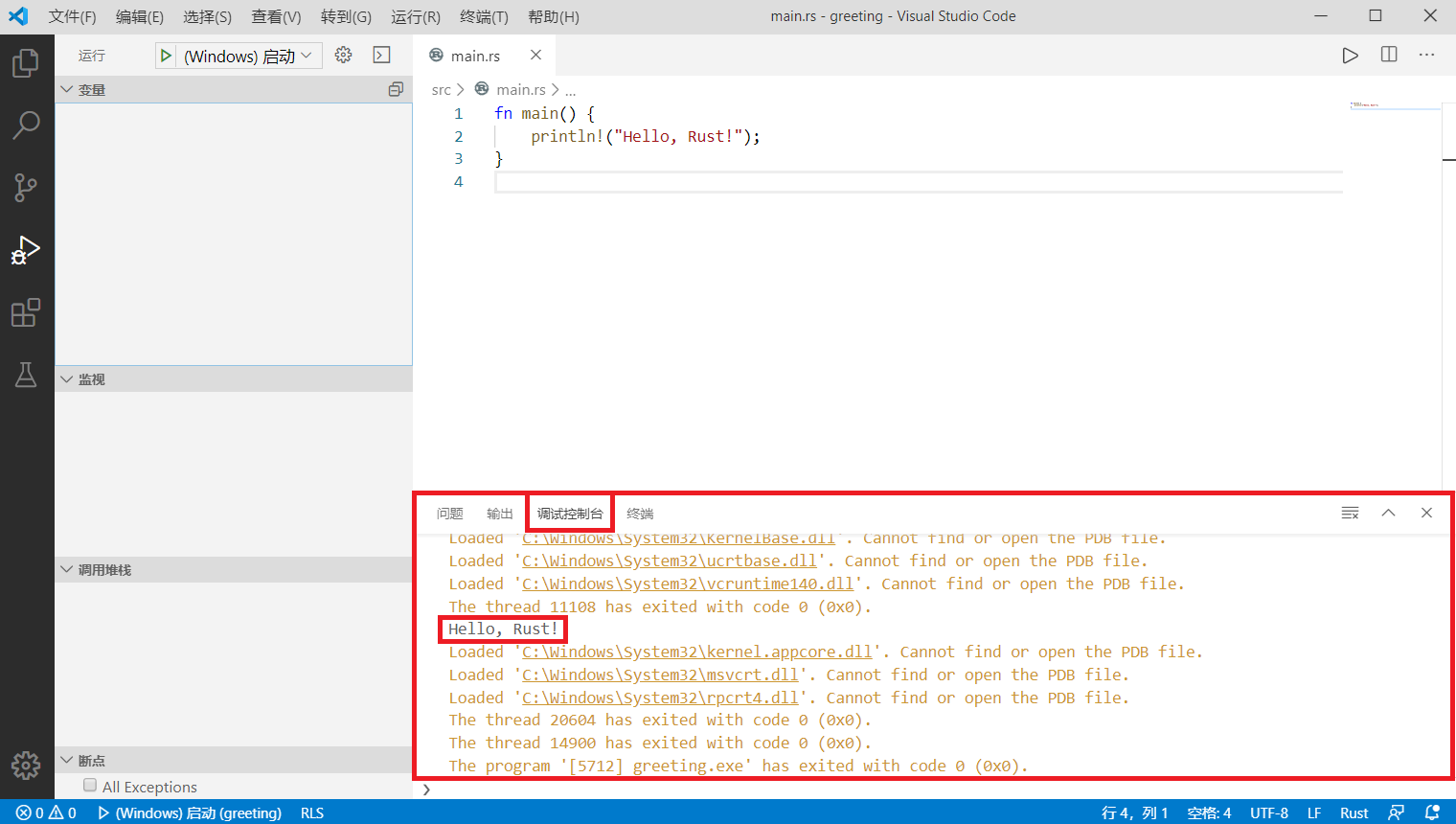

在上一章中我们建立了 greeting 工程,现在我们用 VSCode 打开 greeting 文件夹( 注意不是 runoob-greeting )。

打开 greeting 之后,在里面新建一个新的文件夹 .vscode (注意 vscode 前面的点,如果有这个文件夹就不需要新建了)。在新建的 .vscode 文件夹里新建两个文件 tasks.json 和 launch.json,文件内容如下:

tasks.json

1 | { |

launch.json(mac os)

1 | { |

launch.json(linux)

1 | { |

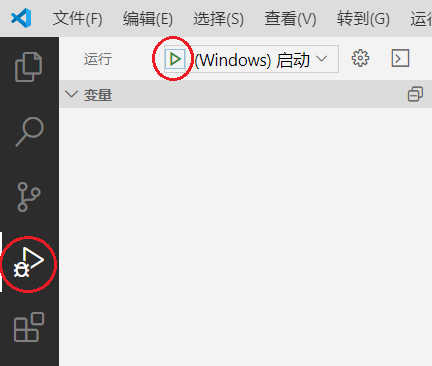

然后点击 VSCode 左栏的 "运行"。

如果你使用的是 MSVC 选择 "(Windows) 启动"。

如果使用的是 MinGW 且安装了 GDB 选择"(gdb)启动",gdb 启动前请注意填写

launch.json 中的 "miDebuggerPath"。

程序就会开始调试运行了。运行输出将出现在"调试控制台"中:

rust声明变量:

1 | let a = 123; |

注意:

Rust 语言不允许精度有损失的自动数据类型转换

在语言层面尽量少的让变量的值可以改变。所以 a 的值不可变。但这不意味着 a 不是"变量"(英文中的 variable),官方文档称 a 这种变量为"不可变变量"。

如果我们编写的程序的一部分在假设值永远不会改变的情况下运行,而我们代码的另一部分在改变该值,那么代码的第一部分可能就不会按照设计的意图去运转。由于这种原因造成的错误很难在事后找到。这是 Rust 语言设计这种机制的原因。

当然,使变量变得"可变"(mutable)只需一个 mut 关键字。

1 | let mut a =123; |

变量的值可以"重新绑定",但在"重新绑定"以前不能私自被改变,这样可以确保在每一次"绑定"之后的区域里编译器可以充分的推理程序逻辑

1 | let a = 123; // 可以编译,但可能有警告,因为该变量没有被使用 |

Rust函数:

1 | fn <函数名> ( <参数> ) <函数体> |

Rust 中可以在一个用 {} 包括的块里编写一个较为复杂的表达式:

1 | fn main() { |

注意:x + 1 之后没有分号,否则它将变成一条语句!

这种表达式块是一个合法的函数体。而且在 Rust 中,函数定义可以嵌套:

实例

1 | fn main() { |

Rust 函数声明返回值类型的方式:在参数声明之后用 -> 来声明函数返回值的类型(不是 : )。

在函数体中,随时都可以以 return 关键字结束函数运行并返回一个类型合适的值。这也是最接近大多数开发者经验的做法:

1 | fn add(a: i32, b: i32) -> i32 { |

但是 Rust 不支持自动返回值类型判断!如果没有明确声明函数返回值的类型,函数将被认为是"纯过程",不允许产生返回值,return 后面不能有返回值表达式。这样做的目的是为了让公开的函数能够形成可见的公报。

注意: 函数体表达式并不能等同于函数体,它不能使用 return** 关键字。**

Rust 条件语句:

1 | fn main() { |

if <condition> { block 1 } else { block 2 }

示例:

1 | fn main() { |

Rust 循环

rust while循环

1 | fn main() { |

在 C 语言中 for 循环使用for (i = 0; i < 10; i++)三元语句控制循环,但是 Rust 中没有这种用法,需要用 while 循环来代替:

1 | let mut i = 0; |

rust for循环

1 | fn main() { |

rust loop 循环(相当于while(true))

1 | fn main() { |

loop 循环可以通过 break 关键字类似于 return 一样使整个循环退出并给予外部一个返回值。这是一个十分巧妙的设计,因为 loop 这样的循环常被用来当作查找工具使用,如果找到了某个东西当然要将这个结果交出去:

1 | fn main() { |

运行结果:

1 | 'O' 的索引为 3 |

Rust 迭代器

使用 iter() 方法创建借用迭代器:

1 | let vec = vec![1,2,3,4,5]; |

使用 iter_mut() 方法创建可变借用迭代器:

1 | let mut vec = vec![1,2,3,4,5]; |

使用 into_iter() 方法创建获取所有权的迭代器:

1 | let vec = vec![1,2,3,4,5]; |

Rust 的迭代器提供了丰富的方法来处理集合中的元素,其中一些常见的方法包括:

map():对每个元素应用给定的转换函数。filter():根据给定的条件过滤集合中的元素。fold():对集合中的元素进行累积处理。skip():跳过指定数量的元素。take():获取指定数量的元素。enumerate():为每个元素提供索引。- ......

使用 map() 方法对每个元素进行转换:

1 | let vec = vec![1,2,3,4,5]; |

使用 filter() 方法根据条件过滤元素:

1 | let vec = vec![1,2,3,4,5]; |

使用 for 循环遍历迭代器

Rust 提供了 for 循环语法来遍历迭代器中的元素,是一种更加简洁和直观的遍历方式。

Rust 的 for 循环底层实际上是使用迭代器的。

1 | let vec = vec![1,2,3,4,5]; |

在这个循环中,vec.iter() 返回一个迭代器,for 循环遍历这个迭代器,并将每个元素赋值给 num 变量,然后执行循环体中的代码。

消费迭代器

使用迭代器直到它被完全消耗。

实例

1 | let arr = vec![1, 2, 3]; |

Rust 闭包

Rust 中的闭包是一种匿名函数,它们可以捕获并存储其环境中的变量。

闭包允许在其定义的作用域之外访问变量,并且可以在需要时将其移动或借用给闭包。

闭包在 Rust 中被广泛应用于函数式编程、并发编程和事件驱动编程等领域。

闭包在 Rust 中非常有用,因为它们提供了一种简洁的方式来编写和使用函数。

以下是 Rust 闭包的一些关键特性和用法:

闭包的语法声明:

1 | |参数...|{表达式} |

参数可以有类型注解,也可以省略,Rust 编译器会根据上下文推断它们。

1 | let add_one =|x: i32| x +1; |

闭包的参数和返回值: 闭包可以有零个或多个参数,并且可以返回一个值。

1 | let calculate =|a, b, c| a * b + c; |

闭包的调用: 闭包可以像函数一样被调用。

1 | let result = calculate(1,2,3); |

使用实例

匿名函数

闭包在 Rust 中类似于匿名函数,可以在代码中以 {} 语法块的形式定义,使用 || 符号来表示参数列表,实例如下:

1 | let add =|a, b| a + b; |

在这个示例中,add 是一个闭包,接受两个参数 a 和 b,返回它们的和。

捕获外部变量

闭包可以捕获周围环境中的变量,这意味着它可以访问定义闭包时所在作用域中的变量。例如:

1 | let x =5; |

以上代码中,闭包 square 捕获了外部变量 x,并在闭包体中使用了它。

移动与借用

闭包可以通过 move 关键字获取外部变量的所有权,或者通过借用的方式获取外部变量的引用。例如:

借用变量: 默认情况下,闭包会借用它捕获的环境中的变量,这意味着闭包可以使用这些变量,但不能改变它们的所有权。这种情况下,闭包和外部作用域都可以使用这些变量。例如:

实例

1 | let x = 10; |

获取所有权: 通过在闭包前添加 move 关键字,闭包会获取它捕获的环境变量的所有权。这意味着这些变量的所有权会从外部作用域转移到闭包内部,外部作用域将无法再使用这些变量。例如:

1 | let s = String::from("hello"); |

Rust 所有权

计算机程序必须在运行时管理它们所使用的内存资源。

大多数的编程语言都有管理内存的功能:

C/C++ 这样的语言主要通过手动方式管理内存,开发者需要手动的申请和释放内存资源。但为了提高开发效率,只要不影响程序功能的实现,许多开发者没有及时释放内存的习惯。所以手动管理内存的方式常常造成资源浪费。

Java 语言编写的程序在虚拟机(JVM)中运行,JVM 具备自动回收内存资源的功能。但这种方式常常会降低运行时效率,所以 JVM 会尽可能少的回收资源,这样也会使程序占用较大的内存资源。

所有权对大多数开发者而言是一个新颖的概念,它是 Rust 语言为高效使用内存而设计的语法机制。所有权概念是为了让 Rust 在编译阶段更有效地分析内存资源的有用性以实现内存管理而诞生的概念。

所有权规则

所有权有以下三条规则:

- Rust 中的每个值都有一个变量,称为其所有者。

- 一次只能有一个所有者。

- 当所有者不在程序运行范围时,该值将被删除。

这三条规则是所有权概念的基础。

接下来将介绍与所有权概念有关的概念。

Rust 中没有调用 free 函数来释放字符串 s 的资源(我知道这样在 C 语言中是不正确的写法,因为 "runoob" 不在堆中,这里假设它在)。Rust 之所以没有明示释放的步骤是因为在变量范围结束的时候,Rust 编译器自动添加了调用释放资源函数的步骤。

这种机制看似很简单了:它不过是帮助程序员在适当的地方添加了一个释放资源的函数调用而已。但这种简单的机制可以有效地解决一个史上最令程序员头疼的编程问题。

变量与数据交互的方式

变量与数据交互方式主要有移动(Move)和克隆(Clone)两种:

移动

多个变量可以在 Rust 中以不同的方式与相同的数据交互:

1 | let x =5; |

这个程序将值 5 绑定到变量 x,然后将 x 的值复制并赋值给变量 y。现在栈中将有两个值 5。此情况中的数据是"基本数据"类型的数据,不需要存储到堆中,仅在栈中的数据的"移动"方式是直接复制,这不会花费更长的时间或更多的存储空间。"基本数据"类型有这些:

- 所有整数类型,例如 i32 、 u32 、 i64 等。

- 布尔类型 bool,值为 true 或 false 。

- 所有浮点类型,f32 和 f64。

- 字符类型 char。

- 仅包含以上类型数据的元组(Tuples)。

但如果发生交互的数据在堆中就是另外一种情况:

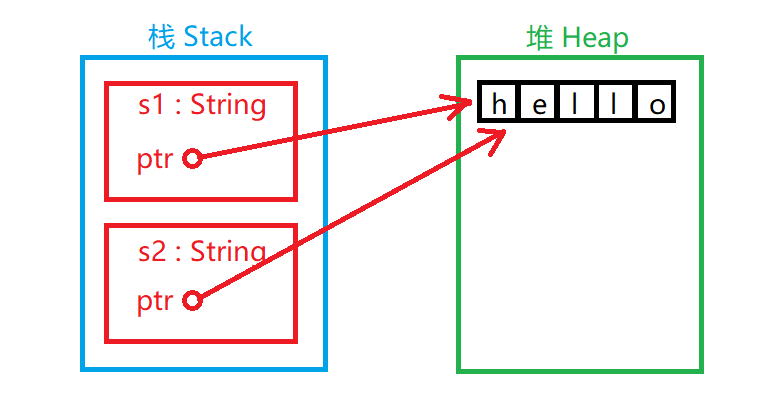

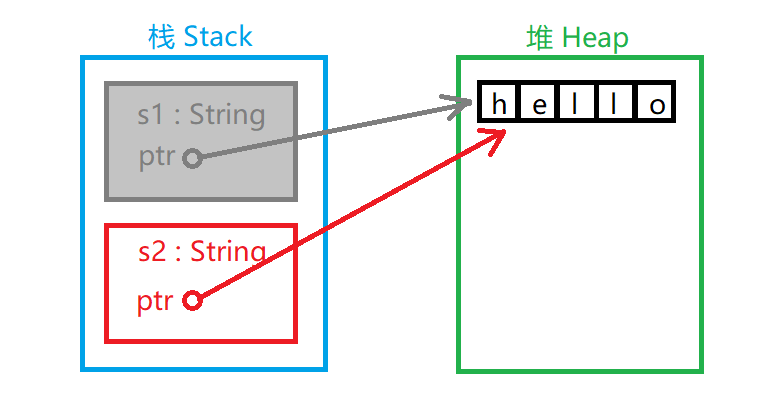

1 | let s1 =String::from("hello"); |

第一步产生一个 String 对象,值为 "hello"。其中 "hello" 可以认为是类似于长度不确定的数据,需要在堆中存储。

第二步的情况略有不同(

这不是完全真的,仅用来对比参考 ):

如图所示:两个 String 对象在栈中,每个 String 对象都有一个指针指向堆中的 "hello" 字符串。在给 s2 赋值时,只有栈中的数据被复制了,堆中的字符串依然还是原来的字符串。

前面我们说过,当变量超出范围时,Rust 自动调用释放资源函数并清理该变量的堆内存。但是 s1 和 s2 都被释放的话堆区中的 "hello" 被释放两次,这是不被系统允许的。为了确保安全,在给 s2 赋值时 s1 已经无效了。没错,在把 s1 的值赋给 s2 以后 s1 将不可以再被使用。下面这段程序是错的:

1 | let s1 =String::from("hello"); |

所以实际情况是:

s1 名存实亡。

克隆

Rust会尽可能地降低程序的运行成本,所以默认情况下,长度较大的数据存放在堆中,且采用移动的方式进行数据交互。但如果需要将数据单纯的复制一份以供他用,可以使用数据的第二种交互方式——克隆。

实例

1 | fn main() { |

运行结果:

1 | s1 = hello, s2 = hello |

这里是真的将堆中的 "hello" 复制了一份,所以 s1 和 s2 都分别绑定了一个值,释放的时候也会被当作两个资源。

当然,克隆仅在需要复制的情况下使用,毕竟复制数据会花费更多的时间。

涉及函数的所有权机制

对于变量来说这是最复杂的情况了。

如果将一个变量当作函数的参数传给其他函数,怎样安全的处理所有权呢?

下面这段程序描述了这种情况下所有权机制的运行原理:

实例

1 | fn main() { |

如果将变量当作参数传入函数,那么它和移动的效果是一样的。

函数返回值的所有权机制

1 | fn main() { |

被当作函数返回值的变量所有权将会被移动出函数并返回到调用函数的地方,而不会直接被无效释放。

引用与租借

引用(Reference)是 C++ 开发者较为熟悉的概念。

如果你熟悉指针的概念,你可以把它看作一种指针。

实质上"引用"是变量的间接访问方式。

实例

1 | fn main() { |

运行结果:

1 | s1 is hello, s2 is hello |

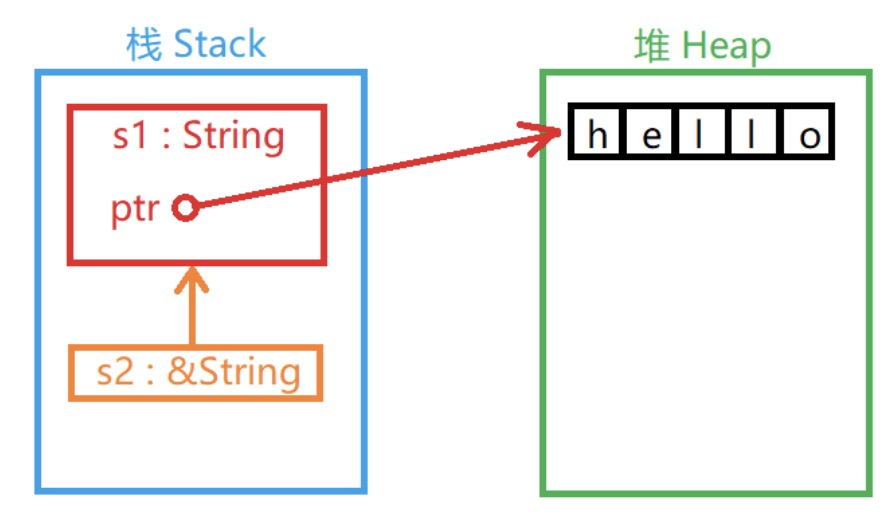

& 运算符可以取变量的"引用"。

当一个变量的值被引用时,变量本身不会被认定无效。因为"引用"并没有在栈中复制变量的值:

引用不会获得值的所有权。

引用只能租借(Borrow)值的所有权。

引用本身也是一个类型并具有一个值,这个值记录的是别的值所在的位置,但引用不具有所指值的所有权:

1 | fn main() { |

这段程序不正确:因为 s2 租借的 s1 已经将所有权移动到 s3,所以 s2 将无法继续租借使用 s1 的所有权。如果需要使用 s2 使用该值,必须重新租借:

1 | fn main() { |

这段程序是正确的。

既然引用不具有所有权,即使它租借了所有权,它也只享有使用权(这跟租房子是一个道理)。

如果尝试利用租借来的权利来修改数据会被阻止:

1 | fn main() { |

这段程序中 s2 尝试修改 s1 的值被阻止,租借的所有权不能修改所有者的值。

当然,也存在一种可变的租借方式,就像你租一个房子,如果物业规定房主可以修改房子结构,房主在租借时也在合同中声明赋予你这种权利,你是可以重新装修房子的:

1 | fn main() { |

这段程序就没有问题了。我们用 &mut 修饰可变的引用类型。

可变引用与不可变引用相比除了权限不同以外,可变引用不允许多重引用,但不可变引用可以:

1 | let mut s = String::from("hello"); |

这段程序不正确,因为多重可变引用了 s。

Rust 对可变引用的这种设计主要出于对并发状态下发生数据访问碰撞的考虑,在编译阶段就避免了这种事情的发生。

由于发生数据访问碰撞的必要条件之一是数据被至少一个使用者写且同时被至少一个其他使用者读或写,所以在一个值被可变引用时不允许再次被任何引用。

垂悬引用(Dangling References)

这是一个换了个名字的概念,如果放在有指针概念的编程语言里它就指的是那种没有实际指向一个真正能访问的数据的指针(注意,不一定是空指针,还有可能是已经释放的资源)。它们就像失去悬挂物体的绳子,所以叫"垂悬引用"。

"垂悬引用"在 Rust 语言里不允许出现,如果有,编译器会发现它。

下面是一个垂悬的典型案例:

1 | fn main() { |

很显然,伴随着 dangle 函数的结束,其局部变量的值本身没有被当作返回值,被释放了。但它的引用却被返回,这个引用所指向的值已经不能确定的存在,故不允许其出现。

Rust Slice(切片)类型(不难)

切片(Slice)是对数据值的部分引用。

切片这个名字往往出现在生物课上,我们做样本玻片的时候要从生物体上获取切片,以供在显微镜上观察。在 Rust 中,切片的意思大致也是这样,只不过它从数据取材引用。

字符串切片

最简单、最常用的数据切片类型是字符串切片(String Slice)。

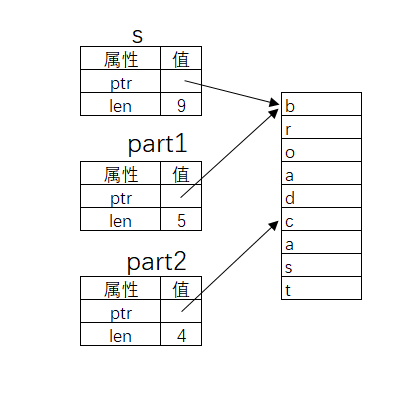

1 | fn main() { |

上图解释了字符串切片的原理(注:Rust 中的字符串类型实质上记录了字符在内存中的起始位置和其长度,我们暂时了解到这一点)。

使用 .. 表示范围的语法在循环章节中出现过。x..y 表示 [x, y) 的数学含义。.. 两边可以没有运算数:

1 | ..y 等价于0..y |

注意: 到目前为止,尽量不要在字符串中使用非英文字符,因为编码的问题。具体原因会在"字符串"章节叙述。

被切片引用的字符串禁止更改其值:

1 | fn main() { |

这段程序不正确。

s 被部分引用,禁止更改其值。

实际上,到目前为止你一定疑惑为什么每一次使用字符串都要这样写String::from("runoob") ,直接写 "runoob" 不行吗?

事已至此我们必须分辨这两者概念的区别了。在 Rust 中有两种常用的字符串类型:str 和 String。

str 是 Rust 核心语言类型,就是本章一直在讲的字符串切片(String Slice),常常以引用的形式出现(&str)。

凡是用双引号包括的字符串常量整体的类型性质都是 &str :

1 | let s = "hello"; |

这里的 s 就是一个 &str 类型的变量。

String 类型是 Rust 标准公共库提供的一种数据类型,它的功能更完善——它支持字符串的追加、清空等实用的操作。String 和 str 除了同样拥有一个字符开始位置属性和一个字符串长度属性以外还有一个容量(capacity)属性。

String 和 str 都支持切片,切片的结果是 &str 类型的数据。

注意:切片结果必须是引用类型,但开发者必须自己明示这一点:

1 | let slice = &s[0..3]; |

有一个快速的办法可以将 String 转换成 &str:

1 | let s1 =String::from("hello"); |

非字符串切片

除了字符串以外,其他一些线性数据结构也支持切片操作,例如数组:

1 | fn main() { |

运行结果:

1 | 1 |

Rust 结构体

结构体定义

这是一个结构体定义:

1 | structSite{ |

注意:如果你常用 C/C++,请记住在 Rust 里 struct 语句仅用来定义,不能声明实例,结尾不需要 ; 符号,而且每个字段定义之后用 , 分隔。

结构体实例

Rust 很多地方受 JavaScript 影响,在实例化结构体的时候用 JSON 对象的 key: value 语法来实现定义:

实例

1 | let runoob = Site { |

如果你不了解 JSON 对象,你可以不用管它,记住格式就可以了:

1 | 结构体类名 { |

这样的好处是不仅使程序更加直观,还不需要按照定义的顺序来输入成员的值。

如果正在实例化的结构体有字段名称和现存变量名称一样的,可以简化书写:

1 | let domain = String::from("www.runoob.com"); |

有这样一种情况:你想要新建一个结构体的实例,其中大部分属性需要被设置成与现存的一个结构体属性一样,仅需更改其中的一两个字段的值,可以使用结构体更新语法:

1 | let site = Site { |

注意:..runoob 后面不可以有逗号。这种语法不允许一成不变的复制另一个结构体实例,意思就是说至少重新设定一个字段的值才能引用其他实例的值。

元组结构体

有一种更简单的定义和使用结构体的方式: 元组结构体 。

元组结构体是一种形式是元组的结构体。

与元组的区别是它有名字和固定的类型格式。它存在的意义是为了处理那些需要定义类型(经常使用)又不想太复杂的简单数据:

1 | structColor(u8, u8, u8); |

"颜色"和"点坐标"是常用的两种数据类型,但如果实例化时写个大括号再写上两个名字就为了可读性牺牲了便捷性,Rust 不会遗留这个问题。元组结构体对象的使用方式和元组一样,通过 . 和下标来进行访问:

1 | fn main() { |

结构体所有权

结构体必须掌握字段值所有权,因为结构体失效的时候会释放所有字段。

这就是为什么本章的案例中使用了 String 类型而不使用 &str 的原因。

但这不意味着结构体中不定义引用型字段,这需要通过"生命周期"机制来实现。

但现在还难以说明"生命周期"概念,所以只能在后面章节说明。

输出结构体

调试中,完整地显示出一个结构体实例是非常有用的。但如果我们手动的书写一个格式会非常的不方便。所以 Rust 提供了一个方便地输出一整个结构体的方法:

实例

1 |

|

如第一行所示:一定要导入调试库 #[derive(Debug)] ,之后在 println 和 print 宏中就可以用 {:?} 占位符输出一整个结构体:

1 | rect1 isRectangle{ width:30, height:50} |

如果属性较多的话可以使用另一个占位符 {:#?} 。

输出结果:

1 | rect1 isRectangle{ |

结构体方法

方法(Method)和函数(Function)类似,只不过它是用来操作结构体实例的。

Rust 语言不是面向对象的,从它所有权机制的创新可以看出这一点。但是面向对象的珍贵思想可以在 Rust 实现。

结构体方法的第一个参数必须是 &self,不需声明类型,因为 self 不是一种风格而是关键字。

计算一个矩形的面积:

1 | struct Rectangle { |

请注意,在调用结构体方法的时候不需要填写 self ,这是出于对使用方便性的考虑。

一个多参数的例子:

1 | struct Rectangle { |

结构体关联函数

之所以"结构体方法"不叫"结构体函数"是因为"函数"这个名字留给了这种函数:它在 impl 块中却没有 &self 参数。

这种函数不依赖实例,但是使用它需要声明是在哪个 impl 块中的。

一直使用的 String::from 函数就是一个"关联函数"。

1 |

|

贴士: 结构体 impl 块可以写几次,效果相当于它们内容的拼接!

单元结构体

结构体可以只作为一种象征而无需任何成员:

1 | structUnitStruct; |

我们称这种没有身体的结构体为单元结构体(Unit Struct)。

Rust 枚举类

枚举类在 Rust 中并不像其他编程语言中的概念那样简单,但依然可以十分简单的使用:

实例

1 | #[derive(Debug)] |

运行结果:

1 | Papery |

match 语法

枚举的目的是对某一类事物的分类,分类的目的是为了对不同的情况进行描述。基于这个原理,往往枚举类最终都会被分支结构处理(许多语言中的 switch )。 switch 语法很经典,但在 Rust 中并不支持,很多语言摒弃 switch 的原因都是因为 switch 容易存在因忘记添加 break 而产生的串接运行问题,Java 和 C# 这类语言通过安全检查杜绝这种情况出现。

Rust 通过 match 语句来实现分支结构。先认识一下如何用 match 处理枚举类:

1 | fn main() { |

运行结果:

1 | Papery book 1001 |

match 块也可以当作函数表达式来对待,它也是可以有返回值的:

1 | match 枚举类实例{ |

但是所有返回值表达式的类型必须一样!

如果把枚举类附加属性定义成元组,在 match 块中需要临时指定一个名字:

1 | enum Book { |

match 除了能够对枚举类进行分支选择以外,还可以对整数、浮点数、字符和字符串切片引用(&str)类型的数据进行分支选择。其中,浮点数类型被分支选择虽然合法,但不推荐这样使用,因为精度问题可能会导致分支错误。

对非枚举类进行分支选择时必须注意处理例外情况,即使在例外情况下没有任何要做的事 . 例外情况用下划线 **_** 表示:

1 | fn main() { |

Option 枚举类

Option 是 Rust 标准库中的枚举类,这个类用于填补 Rust 不支持 null 引用的空白。

许多语言支持 null 的存在(C/C++、Java),这样很方便,但也制造了极大的问题,null 的发明者也承认这一点,"一个方便的想法造成累计 10 亿美元的损失"。

null 经常在开发者把一切都当作不是 null 的时候给予程序致命一击:毕竟只要出现一个这样的错误,程序的运行就要彻底终止。

为了解决这个问题,很多语言默认不允许 null,但在语言层面支持 null 的出现(常在类型前面用 ? 符号修饰)。

Java 默认支持 null,但可以通过 @NotNull 注解限制出现 null,这是一种应付的办法。

Rust 在语言层面彻底不允许空值 null 的存在,但无奈null 可以高效地解决少量的问题,所以 Rust 引入了 Option 枚举类:

1 | enum Option<T> { |

如果你想定义一个可以为空值的类,你可以这样:

1 | let opt =Option::Some("Hello"); |

如果你想针对 opt 执行某些操作,你必须先判断它是否是 Option::None :

1 | fn main() { |

如果你的变量刚开始是空值,你体谅一下编译器,它怎么知道值不为空的时候变量是什么类型的呢?

所以初始值为空的 Option 必须明确类型:

1 | fn main() { |

这种设计会让空值编程变得不容易,但这正是构建一个稳定高效的系统所需要的。由于 Option 是 Rust 编译器默认引入的,在使用时可以省略 Option:: 直接写 None 或者 Some()。

Option 是一种特殊的枚举类,它可以含值分支选择:

1 | fn main() { |

if let 语法

1 | let i = 0; |

这段程序的目的是判断 i 是否是数字 0,如果是就打印 zero。

现在用 if let 语法缩短这段代码:

1 | let i = 0; |

if let 语法格式如下:

1 | if let 匹配值 = 源变量 { |

可以在之后添加一个 else 块来处理例外情况。

if let 语法可以认为是只区分两种情况的 match 语句的"语法糖"(语法糖指的是某种语法的原理相同的便捷替代品)。

对于枚举类依然适用:

1 | fn main() { |

Rust 组织管理

Rust 中有三个重要的组织概念:箱、包、模块。

箱(Crate)

"箱"是二进制程序文件或者库文件,存在于"包"中。

"箱"是树状结构的,它的树根是编译器开始运行时编译的源文件所编译的程序。

注意:"二进制程序文件"不一定是"二进制可执行文件",只能确定是是包含目标机器语言的文件,文件格式随编译环境的不同而不同。

包(Package)

当我们使用 Cargo 执行 new 命令创建 Rust 工程时,工程目录下会建立一个 Cargo.toml 文件。工程的实质就是一个包,包必须由一个 Cargo.toml 文件来管理,该文件描述了包的基本信息以及依赖项。

一个包最多包含一个库"箱",可以包含任意数量的二进制"箱",但是至少包含一个"箱"(不管是库还是二进制"箱")。

当使用 cargo new 命令创建完包之后,src 目录下会生成一个 main.rs 源文件,Cargo 默认这个文件为二进制箱的根,编译之后的二进制箱将与包名相同。

模块(Module)

对于一个软件工程来说,我们往往按照所使用的编程语言的组织规范来进行组织,组织模块的主要结构往往是树。Java 组织功能模块的主要单位是类,而 JavaScript 组织模块的主要方式是 function。

这些先进的语言的组织单位可以层层包含,就像文件系统的目录结构一样。Rust 中的组织单位是模块(Module)。

1 | mod nation { |

这是一段描述法治国家的程序:国家(nation)包括政府(government)、议会(congress)和法院(court),分别有行政、立法和司法的功能。我们可以把它转换成树状结构:

1 | nation |

在文件系统中,目录结构往往以斜杠在路径字符串中表示对象的位置,Rust 中的路径分隔符是 :: 。

路径分为绝对路径和相对路径。绝对路径从 crate 关键字开始描述。相对路径从 self 或 super 关键字或一个标识符开始描述。例如:

1 | crate::nation::government::govern(); |

是描述 govern 函数的绝对路径,相对路径可以表示为:

1 | nation::government::govern(); |

现在你可以尝试在一个源程序里定义类似的模块结构并在主函数中使用路径。

如果你这样做,你一定会发现它不正确的地方:government 模块和其中的函数都是私有(private)的,你不被允许访问它们。

访问权限

Rust 中有两种简单的访问权:公共(public)和私有(private)。

默认情况下,如果不加修饰符,模块中的成员访问权将是私有的。

如果想使用公共权限,需要使用 pub 关键字。

对于私有的模块,只有在与其平级的位置或下级的位置才能访问,不能从其外部访问。

1 | mod nation { |

这段程序是能通过编译的。请注意观察 court 模块中 super 的访问方法。

如果模块中定义了结构体,结构体除了其本身是私有的以外,其字段也默认是私有的。所以如果想使用模块中的结构体以及其字段,需要 pub 声明:

1 | mod back_of_house { |

枚举类枚举项可以内含字段,但不具备类似的性质:

1 | mod SomeModule { |

运行结果:

1 | Blue |

难以发现的模块

使用过 Java 的开发者在编程时往往非常讨厌最外层的 class 块——它的名字与文件名一模一样,因为它就表示文件容器,尽管它很繁琐但我们不得不写一遍来强调"这个类是文件所包含的类"。

不过这样有一些好处:起码它让开发者明明白白的意识到了类包装的存在,而且可以明确的描述类的继承关系。

在 Rust 中,模块就像是 Java 中的类包装,但是文件一开头就可以写一个主函数,这该如何解释呢?

每一个 Rust 文件的内容都是一个"难以发现"的模块。

让我们用两个文件来揭示这一点:

main.rs 文件

1 | // main.rs |

second_module.rs 文件

1 | // second_module.rs |

运行结果:

1 | Thisis the main module. |

use 关键字

use 关键字能够将模块标识符引入当前作用域:

1 | mod nation { |

这段程序能够通过编译。

因为 use 关键字把 govern 标识符导入到了当前的模块下,可以直接使用。

这样就解决了局部模块路径过长的问题。

当然,有些情况下存在两个相同的名称,且同样需要导入,我们可以使用 as 关键字为标识符添加别名:

示例

1 | mod nation { |

这里有两个 govern 函数,一个是 nation 下的,一个是 government 下的,我们用 as 将 nation 下的取别名 nation_govern。两个名称可以同时使用。

use 关键字可以与 pub 关键字配合使用:

1 | mod nation { |

引用标准库

Rust 官方标准库字典:https://doc.rust-lang.org/stable/std/all.html

在学习了本章的概念之后,我们可以轻松的导入系统库来方便的开发程序了:

1 | use std::f64::consts::PI; |

所有的系统库模块都是被默认导入的,所以在使用的时候只需要使用 use 关键字简化路径就可以方便的使用了。

Rust 错误处理

Rust 有一套独特的处理异常情况的机制,它并不像其它语言中的 try 机制那样简单。

首先,程序中一般会出现两种错误:可恢复错误和不可恢复错误。

可恢复错误的典型案例是文件访问错误,如果访问一个文件失败,有可能是因为它正在被占用,是正常的,我们可以通过等待来解决。

但还有一种错误是由编程中无法解决的逻辑错误导致的,例如访问数组末尾以外的位置。

大多数编程语言不区分这两种错误,并用 Exception (异常)类来表示错误。在 Rust 中没有 Exception。

对于可恢复错误用 Result<T, E> 类来处理,对于不可恢复错误使用 panic! 宏来处理。

不可恢复错误

本章以前没有专门介绍 Rust 宏的语法,但已经使用过了 println! 宏,因为这些宏的使用较为简单,所以暂时不需要彻底掌握它,我们可以用同样的方法先学会使用 panic! 宏的使用方法。

1 | fn main() { |

运行结果:

1 | thread 'main' panicked at 'error occured', src\main.rs:3:5 |

很显然,程序并不能如约运行到 println!("Hello, Rust") ,而是在 panic! 宏被调用时停止了运行。

不可恢复的错误一定会导致程序受到致命的打击而终止运行。

让我们注视错误输出的两行:

- 第一行输出了 panic! 宏调用的位置以及其输出的错误信息。

- 第二行是一句提示,翻译成中文就是"通过

RUST_BACKTRACE=1环境变量运行以显示回溯"。接下来我们将介绍回溯(backtrace)。

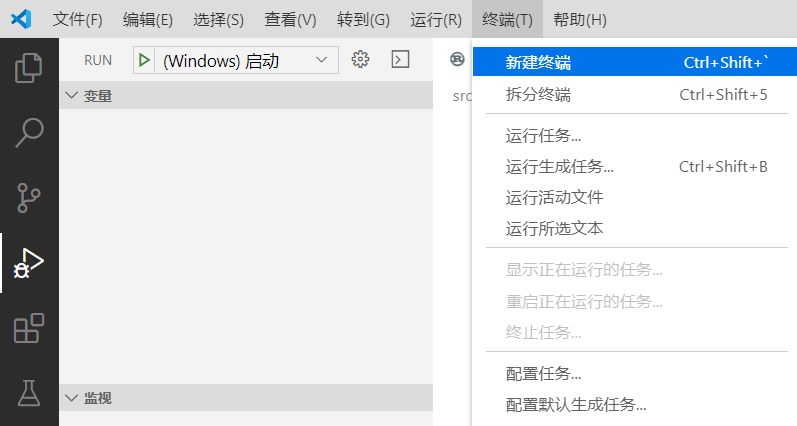

紧接着刚才的例子,我们在 VSCode 中新建一个终端:

在新建的终端里设置环境变量(不同的终端方法不同,这里介绍两种主要的方法):

如果在 Windows 7 及以上的 Windows 系统版本中,默认使用的终端命令行是 Powershell,请使用以下命令:

1 | $env:RUST_BACKTRACE=1; cargo run |

如果你使用的是 Linux 或 macOS 等 UNIX 系统,一般情况下默认使用的是 bash 命令行,请使用以下命令:

1 | RUST_BACKTRACE=1 cargo run |

然后,你会看到以下文字:

1 | thread 'main' panicked at 'error occured', src\main.rs:3:5 |

回溯是不可恢复错误的另一种处理方式,它会展开运行的栈并输出所有的信息,然后程序依然会退出。上面的省略号省略了大量的输出信息,我们可以找到我们编写的 panic! 宏触发的错误。

可恢复的错误

此概念十分类似于 Java 编程语言中的异常。实际上在 C 语言中我们就常常将函数返回值设置成整数来表达函数遇到的错误,在 Rust 中通过 Result<T, E> 枚举类作返回值来进行异常表达:

1 | enumResult<T, E>{ |

在 Rust 标准库中可能产生异常的函数的返回值都是 Result 类型的。例如:当我们尝试打开一个文件时:

1 | use std::fs::File; |

如果 hello.txt 文件不存在,会打印 "Failed to open the file." 。

当然,我们在枚举类章节讲到的 if let 语法可以简化 match 语法块:

1 | use std::fs::File; |

如果想使一个可恢复错误按不可恢复错误处理,Result 类提供了两个办法:unwrap() 和 expect(message: &str) :

1 | use std::fs::File; |

这段程序相当于在 Result 为 Err 时调用 panic! 宏。两者的区别在于 expect 能够向 panic! 宏发送一段指定的错误信息。

可恢复的错误的传递

之前所讲的是接收到错误的处理方式,但是如果我们自己编写一个函数在遇到错误时想传递出去怎么办呢?

1 | fn f(i: i32) -> Result<i32, bool> { |

运行结果:

1 | Ok: f(-1)=10000 |

这段程序中函数 f 是错误的根源,现在我们再写一个传递错误的函数 g :

1 | fn g(i: i32) -> Result<i32, bool> { |

函数 g 传递了函数 f 可能出现的错误(这里的 g 只是一个简单的例子,实际上传递错误的函数一般还包含很多其它操作)。

这样写有些冗长,Rust 中可以在 Result 对象后添加 ? 操作符将同类的 Err 直接传递出去:

1 | fn f(i: i32) -> Result<i32, bool> { |

运行结果:

1 | Ok: g(10000)=10000 |

? 符的实际作用是将 Result 类非异常的值直接取出,如果有异常就将异常 Result 返回出去。所以,? 符仅用于返回值类型为 Result<T, E> 的函数,其中 E 类型必须和 ? 所处理的 Result 的 E 类型一致。

kind 方法

到此为止,Rust 似乎没有像 try 块一样可以令任何位置发生的同类异常都直接得到相同的解决的语法,但这样并不意味着 Rust 实现不了:我们完全可以把 try 块在独立的函数中实现,将所有的异常都传递出去解决。实际上这才是一个分化良好的程序应当遵循的编程方法:应该注重独立功能的完整性。

但是这样需要判断 Result 的 Err 类型,获取 Err 类型的函数是 kind()。

1 | use std::io; |

运行结果:

1 | No such file |

Rust 泛型与特性

泛型是一个编程语言不可或缺的机制。

C++ 语言中用"模板"来实现泛型,而 C 语言中没有泛型的机制,这也导致 C 语言难以构建类型复杂的工程。

泛型机制是编程语言用于表达类型抽象的机制,一般用于功能确定、数据类型待定的类,如链表、映射表等。

在函数中定义泛型

这是一个对整型数字选择排序的方法:

1 | fn max(array: &[i32]) -> i32 { |

这是一个简单的取最大值程序,可以用于处理 i32 数字类型的数据,但无法用于 f64 类型的数据。通过使用泛型我们可以使这个函数可以利用到各个类型中去。但实际上并不是所有的数据类型都可以比大小,所以接下来一段代码并不是用来运行的,而是用来描述一下函数泛型的语法格式:

1 | fn max<T>(array: &[T]) -> T { |

结构体与枚举类中的泛型

在之前我们学习的 Option 和 Result 枚举类就是泛型的。

Rust 中的结构体和枚举类都可以实现泛型机制。

1 | struct Point<T> { |

这是一个点坐标结构体,T 表示描述点坐标的数字类型。我们可以这样使用:

1 | let p1 = Point {x: 1, y: 2}; |

使用时并没有声明类型,这里使用的是自动类型机制,但不允许出现类型不匹配的情况如下:

1 | let p = Point {x: 1, y: 2.0}; |

x 与 1 绑定时就已经将 T 设定为 i32,所以不允许再出现 f64 的类型。如果我们想让 x 与 y 用不同的数据类型表示,可以使用两个泛型标识符:

1 | struct Point<T1, T2> { |

在枚举类中表示泛型的方法诸如 Option 和 Result:

1 | enum Option<T> { |

结构体与枚举类都可以定义方法,那么方法也应该实现泛型的机制,否则泛型的类将无法被有效的方法操作。

1 | struct Point<T> { |

运行结果:

1 | p.x =1 |

注意,impl 关键字的后方必须有

<T>,因为它后面的 T

是以之为榜样的。但我们也可以为其中的一种泛型添加方法:

1 | impl Point<f64>{ |

impl 块本身的泛型并没有阻碍其内部方法具有泛型的能力:

1 | impl<T, U>Point<T, U>{ |

方法 mixup 将一个 Point<T, U> 点的 x 与 Point<V, W> 点的 y 融合成一个类型为 Point<T, W> 的新点。

特性(trait)

特性(trait)概念接近于 Java 中的接口(Interface),但两者不完全相同。特性与接口相同的地方在于它们都是一种行为规范,可以用于标识哪些类有哪些方法。

特性在 Rust 中用 trait 表示:

1 | trait Descriptive{ |

Descriptive 规定了实现者必需有 describe(&self) -> String 方法。

我们用它实现一个结构体:

1 | struct Person { |

格式是:

1 | impl <特性名> for <所实现的类型名> |

Rust 同一个类可以实现多个特性,每个 impl 块只能实现一个。

默认特性

这是特性与接口的不同点:接口只能规范方法而不能定义方法,但特性可以定义方法作为默认方法,因为是"默认",所以对象既可以重新定义方法,也可以不重新定义方法使用默认的方法:

1 | trait Descriptive { |

运行结果:

1 | Cali 24 |

如果我们将 impl Descriptive for Person 块中的内容去掉,那么运行结果就是:

1 | [Object] |

特性做参数

很多情况下我们需要传递一个函数做参数,例如回调函数、设置按钮事件等。在 Java 中函数必须以接口实现的类实例来传递,在 Rust 中可以通过传递特性参数来实现:

1 | fn output(object: impl Descriptive){ |

任何实现了 Descriptive 特性的对象都可以作为这个函数的参数,这个函数没必要了解传入对象有没有其他属性或方法,只需要了解它一定有 Descriptive 特性规范的方法就可以了。当然,此函数内也无法使用其他的属性与方法。

特性参数还可以用这种等效语法实现:

1 | fn output<T:Descriptive>(object: T){ |

这是一种风格类似泛型的语法糖,这种语法糖在有多个参数类型均是特性的情况下十分实用:

1 | fn output_two<T:Descriptive>(arg1: T, arg2: T){ |

特性作类型表示时如果涉及多个特性,可以用 + 符号表示,例如:

1 | fn notify(item: impl Summary+Display) |

注意: 仅用于表示类型的时候,并不意味着可以在 impl 块中使用。

复杂的实现关系可以使用 where 关键字简化,例如:

1 | fn some_function<T:Display+Clone, U:Clone+Debug>(t: T, u: U) |

可以简化成:

1 | fn some_function<T, U>(t: T, u: U)-> i32 |

在了解这个语法之后,泛型章节中的"取最大值"案例就可以真正实现了:

1 | trait Comparable { |

运行结果:

1 | maximum of arr is5 |

Tip: 由于需要声明 compare 函数的第二参数必须与实现该特性的类型相同,所以 Self (注意大小写)关键字就代表了当前类型(不是实例)本身。

特性做返回值

特性做返回值格式如下:

1 | fn person() -> impl Descriptive { |

但是有一点,特性做返回值只接受实现了该特性的对象做返回值且在同一个函数中所有可能的返回值类型必须完全一样。比如结构体 A 与结构体 B 都实现了特性 Trait,下面这个函数就是错误的:

1 | fn some_function(bool bl) -> impl Descriptive { |

有条件实现方法

impl 功能十分强大,我们可以用它实现类的方法。但对于泛型类来说,有时我们需要区分一下它所属的泛型已经实现的方法来决定它接下来该实现的方法:

1 | struct A<T> {} |

这段代码声明了 A <T> 类型必须在 T 已经实现 B 和 C

特性的前提下才能有效实现此 impl 块。

Rust 生命周期

Rust 生命周期机制是与所有权机制同等重要的资源管理机制。

之所以引入这个概念主要是应对复杂类型系统中资源管理的问题。

引用是对待复杂类型时必不可少的机制,毕竟复杂类型的数据不能被处理器轻易地复制和计算。

但引用往往导致极其复杂的资源管理问题,首先认识一下垂悬引用:

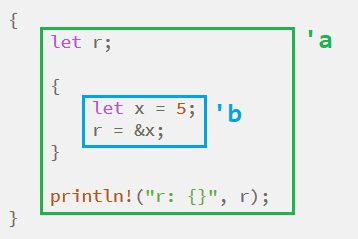

1 | { |

这段代码是不会通过 Rust 编译器的,原因是 r 所引用的值已经在使用之前被释放。

上图中的绿色范围 'a 表示 r 的生命周期,蓝色范围 'b 表示 x 的生命周期。很显然,'b 比 'a 小得多,引用必须在值的生命周期以内才有效。

一直以来我们都在结构体中使用 String 而不用 &str,我们用一个案例解释原因:

1 | fn longer(s1: &str, s2: &str) -> &str { |

longer 函数取 s1 和 s2 两个字符串切片中较长的一个返回其引用值。但只这段代码不会通过编译,原因是返回值引用可能会返回过期的引用:

1 | fn main() { |

这段程序中虽然经过了比较,但 r 被使用的时候源值 s1 和 s2 都已经失效了。当然我们可以把 r 的使用移到 s1 和 s2 的生命周期范围以内防止这种错误的发生,但对于函数来说,它并不能知道自己以外的地方是什么情况,它为了保障自己传递出去的值是正常的,必选所有权原则消除一切危险,所以 longer 函数并不能通过编译。

注: &str和String类型的区别如下:

1 | let a = "hello world"; |

- 上面的a, b 是&str,不是String,&str更像一个固定的数组,String像一个可变的数组。

- String保留了一个len()和capacity(),但str只有一个len()。

- &str 是 str的一个的borrowed 类型,可以称为一个字符串切片,一个不可变的string。

如果只想要一个字符串的只读视图,或者&str作为一个函数的参数,那就首选&str。如果想拥有所有权,想修改字符串那就用String吧。

生命周期注释

生命周期注释是描述引用生命周期的办法。

虽然这样并不能够改变引用的生命周期,但可以在合适的地方声明两个引用的生命周期一致。

生命周期注释用单引号开头,跟着一个小写字母单词:

1 | &i32 // 常规引用 |

让我们用生命周期注释改造 longer 函数:

1 | fn longer<'a>(s1: &'a str, s2: &'a str) -> &'a str { |

我们需要用泛型声明来规范生命周期的名称,随后函数返回值的生命周期将与两个参数的生命周期一致,所以在调用时可以这样写:

1 | fn main() { |

以上两段程序结合的运行结果:

1 | ecmascript is longer |

注意: 别忘记了自动类型判断的原则。

结构体中使用字符串切片引用

这是之前留下的疑问,在此解答:

1 | fn main() { |

运行结果:

1 | s.content = string_slice |

如果对结构体 Str 有方法定义:

1 | impl<'a> Str<'a> { |

这里返回值并没有生命周期注释,但是加上也无妨。这是一个历史问题,早期 Rust 不支持生命周期自动判断,所有的生命周期必须严格声明,但主流稳定版本的 Rust 已经支持了这个功能。

静态生命周期

生命周期注释有一个特别的:'static 。所有用双引号包括的字符串常量所代表的精确数据类型都是 &'static str ,'static 所表示的生命周期从程序运行开始到程序运行结束。

泛型、特性与生命周期协同作战

1 | use std::fmt::Display; |

这段程序出自 Rust 圣经,是一个同时使用了泛型、特性、生命周期机制的程序,不强求,可以体验,毕竟早晚用得到!

Rust 面向对象

面向对象的编程语言通常实现了数据的封装与继承并能基于数据调用方法。

Rust 不是面向对象的编程语言,但这些功能都得以实现。

封装

封装就是对外显示的策略,在 Rust 中可以通过模块的机制来实现最外层的封装,并且每一个 Rust 文件都可以看作一个模块,模块内的元素可以通过 pub 关键字对外明示。这一点在"组织管理"章节详细叙述过。

"类"往往是面向对象的编程语言中常用到的概念。"类"封装的是数据,是对同一类数据实体以及其处理方法的抽象。在 Rust 中,我们可以使用结构体或枚举类来实现类的功能:

1 | pub struct ClassName { |

下面建造一个完整的类:

1 | second.rs |

继承

几乎其他的面向对象的编程语言都可以实现"继承",并用"extend"词语来描述这个动作。

继承是多态(Polymorphism)思想的实现,多态指的是编程语言可以处理多种类型数据的代码。在 Rust 中,通过特性(trait)实现多态。有关特性的细节已在"特性"章节给出。但是特性无法实现属性的继承,只能实现类似于"接口"的功能,所以想继承一个类的方法最好在"子类"中定义"父类"的实例。

总结地说,Rust 没有提供跟继承有关的语法糖,也没有官方的继承手段(完全等同于 Java 中的类的继承),但灵活的语法依然可以实现相关的功能。

Rust 宏

Rust 宏(Macros)是一种在编译时生成代码的强大工具,它允许你在编写代码时创建自定义语法扩展。

宏(Macro)是一种在代码中进行元编程(Metaprogramming)的技术,它允许在编译时生成代码,宏可以帮助简化代码,提高代码的可读性和可维护性,同时允许开发者在编译时执行一些代码生成的操作。

宏在 Rust 中有两种类型:声明式宏(Declarative Macros)和过程宏(Procedural Macros)。

本文主要介绍声明式宏。

宏的定义

在 Rust 中,使用 macro_rules! 关键字来定义声明式宏。

1 | macro_rules! my_macro { |

声明式宏使用 macro_rules! 关键字进行定义,它们被称为 "macro_rules" 宏。这种宏的定义是基于模式匹配的,可以匹配代码的结构并根据匹配的模式生成相应的代码。这样的宏在不引入新的语法结构的情况下,可以用来简化一些通用的代码模式。

下面是一个简单的宏定义的例子:

1 | // 宏的定义 |

说明

- 模式匹配: 宏通过模式匹配来匹配传递给宏的代码片段,模式是宏规则的左侧部分,用于捕获不同的代码结构。

- 规则: 宏规则是一组由 $ 引导的模式和相应的展开代码,规则由分号分隔。

- 宏的展开: 当宏被调用时,匹配的模式将被替换为相应的展开代码,展开代码是宏规则的右侧部分。

实例

下面是一个更复杂的例子,演示了如何使用宏创建一个简单的 vec! 宏,以便更方便地创建 Vec:

1 | // 宏的定义 |

在这个例子中,vec! 宏使用了模式匹配,以及

注意,$(,)?) 用于处理末尾的逗号,使得在不同的使用情境下都能正常工作。

($($element:expr),+ $(,)?) 是 Rust

声明宏中用于模式匹配的一部分。它的具体含义如下:

$($element:expr):这是一个重复匹配的部分。其中$element:expr表示匹配一个表达式,并将其绑定到元变量$element上。$()表示可以匹配零个或多个这样的表达式。,+:表示在匹配了前面的表达式之后,紧接着可以有一个或多个逗号。$(,)?):这里的$(,)?表示可选的单个逗号。其中?表示该部分是可选的,即可以有逗号,也可以没有逗号。

总的来说,($($element:expr),+ $(,)?)

用于匹配一个或多个表达式,这些表达式之间可以用逗号分隔,并且最后可能有一个可选的逗号。

过程宏(Procedural Macros)

过程宏是一种更为灵活和强大的宏,允许在编译时通过自定义代码生成过程来操作抽象语法树(AST)。过程宏在功能上更接近于函数,但是它们在编写和使用上更加复杂。

过程宏的类型:

- 派生宏(Derive Macros) :用于自动实现trait(比如

Copy、Debug)的宏。 - 属性宏(Attribute Macros)

:用于在声明上附加额外的元数据,如

#[derive(Debug)]。

过程宏的实现通常需要使用 proc_macro 库提供的功能,例如 TokenStream 和 TokenTree,以便更直接地操纵源代码。

Rust 智能指针

智能指针(Smart pointers)是一种在 Rust 中常见的数据结构,它们提供了额外的功能和安全性保证,以帮助管理内存和数据。

在 Rust 中,智能指针是一种封装了对动态分配内存的所有权和生命周期管理的数据类型。

智能指针通常封装了一个原始指针,并提供了一些额外的功能,比如引用计数、所有权转移、生命周期管理等。

在 Rust 中,标准库提供了几种常见的智能指针类型,例如 Box、Rc、Arc 和 RefCell。

智能指针的使用场景:

- 当需要在堆上分配内存时,使用

Box<T>。 - 当需要多处共享所有权时,使用

Rc<T>或Arc<T>。 - 当需要内部可变性时,使用

RefCell<T>。 - 当需要线程安全的共享所有权时,使用

Arc<T>。 - 当需要互斥访问数据时,使用

Mutex<T>。 - 当需要读取-写入访问数据时,使用

RwLock<T>。 - 当需要解决循环引用问题时,使用

Weak<T>。

Box <T> 智能指针

Box <T> 是 Rust

中最简单的智能指针之一,它允许在堆上分配一块内存,并将值存储在这个内存中。

由于 Rust 的所有权规则,使用 Box 可以在堆上创建具有已知大小的数据。

1 | let b = Box::new(5); |

Rc <T> 智能指针

Rc

<T>(引用计数指针)允许多个所有者共享数据,它使用引用计数来跟踪数据的所有者数量,并在所有者数量为零时释放数据。

Rc <T> 适用于单线程环境下的数据共享。

1 | use std::rc::Rc; |

Arc <T> 智能指针

Arc <T>(原子引用计数指针)与 Rc

<T>

类似,但是可以安全地在多线程环境中共享数据,因为它使用原子操作来更新引用计数。

1 | use std::sync::Arc; |

RefCell <T> 智能指针

RefCell <T>

允许在运行时检查借用规则,它使用内部可变性来提供了一种安全的内部可变性模式,允许在不可变引用的情况下修改数据。

但是,RefCell <T> 只能用于单线程环境。

1 | use std::cell::RefCell; |

Mutex <T> 智能指针

Mutex <T>

是一个互斥锁,它保证了在任何时刻只有一个线程可以访问 Mutex

内部的数据。

1 | use std::sync::Mutex; |

RwLock <T> 智能指针

RwLock <T>

是一种读取-写入锁,允许多个读取者同时访问数据,但在写入时是排他的。

1 | use std::sync::RwLock; |

Weak <T> 智能指针

Weak <T> 是 Rc <T>

的非拥有智能指针,它不增加引用计数,用于解决循环引用问题。

1 | use std::rc::{Rc, Weak}; |

智能指针的生命周期管理

智能指针可以帮助管理数据的生命周期,当智能指针被销毁时,它们会自动释放内存,从而避免了内存泄漏和野指针的问题。

此外,智能指针还允许在创建时指定特定的析构函数,以实现自定义的资源管理。

实例

下面是一个简单的 Rust 智能指针完整实例,该示例使用 Rc

<T>

智能指针实现了一个简单的引用计数功能,并演示了多个所有者共享数据的情况。

1 | // 引入所需的依赖库 |

以上代码中,我们首先定义了一个 Data

结构体,用于存储一个整数值。然后在 main 函数中创建了一个

Rc<Data> 智能指针,用于共享数据。接着通过

Rc::clone

方法克隆了两个智能指针,增加了数据的引用计数。最后打印了数据的值、引用计数和克隆后的智能指针。

运行该程序,可以看到输出了数据的值和引用计数,以及克隆后的智能指针。由于

Rc

智能指针使用引用计数来跟踪数据的所有者数量,因此在每次克隆时,数据的引用计数会增加,当所有者数量为零时,数据会被自动释放。

输出结果如下:

1 | Data value:5 |

总结

Rust 的智能指针提供了一种安全和自动化的方式来管理内存和共享所有权。

智能指针是 Rust 中非常重要的一种数据结构,它们提供了一种安全、灵活和方便的内存管理方式,帮助程序员避免了常见的内存安全问题,提高了代码的可靠性和可维护性。

智能指针是 Rust 安全性模型的重要组成部分,允许开发者编写低级代码而不必担心内存安全问题。

通过智能指针,Rust 既保持了 C 语言的控制能力,又避免了其风险。

Rust 并发编程

安全高效的处理并发是 Rust 诞生的目的之一,主要解决的是服务器高负载承受能力。

并发(concurrent)的概念是指程序不同的部分独立执行,这与并行(parallel)的概念容易混淆,并行强调的是"同时执行"。

并发往往会造成并行。

本章讲述与并发相关的编程概念和细节。

线程

线程(thread)是一个程序中独立运行的一个部分。

线程不同于进程(process)的地方是线程是程序以内的概念,程序往往是在一个进程中执行的。

在有操作系统的环境中进程往往被交替地调度得以执行,线程则在进程以内由程序进行调度。

由于线程并发很有可能出现并行的情况,所以在并行中可能遇到的死锁、延宕错误常出现于含有并发机制的程序。

为了解决这些问题,很多其它语言(如 Java、C#)采用特殊的运行时(runtime)软件来协调资源,但这样无疑极大地降低了程序的执行效率。

C/C++ 语言在操作系统的最底层也支持多线程,且语言本身以及其编译器不具备侦察和避免并行错误的能力,这对于开发者来说压力很大,开发者需要花费大量的精力避免发生错误。

Rust 不依靠运行时环境,这一点像 C/C++ 一样。

但 Rust 在语言本身就设计了包括所有权机制在内的手段来尽可能地把最常见的错误消灭在编译阶段,这一点其他语言不具备。

但这不意味着我们编程的时候可以不小心,迄今为止由于并发造成的问题还没有在公共范围内得到完全解决,仍有可能出现错误,并发编程时要尽量小心!

Rust 中通过 std::thread::spawn 函数创建新线程:

1 | use std::thread; |

运行结果:

1 | main thread print0 |

这个结果在某些情况下顺序有可能变化,但总体上是这样打印出来的。

此程序有一个子线程,目的是打印 5 行文字,主线程打印三行文字,但很显然随着主线程的结束,spawn 线程也随之结束了,并没有完成所有打印。

std::thread::spawn 函数的参数是一个无参函数,但上述写法不是推荐的写法,我们可以使用闭包(closures)来传递函数作为参数:

1 | use std::thread; |

闭包是可以保存进变量或作为参数传递给其他函数的匿名函数。闭包相当于 Rust 中的 Lambda 表达式,格式如下:

1 | |参数1,参数2,...|->返回值类型{ |

例如:

1 | fn main() { |

运行结果:

1 | inc(5)=6 |

闭包可以省略类型声明使用 Rust 自动类型判断机制:

1 | fn main() { |

结果没有变化。

join 方法

1 | use std::thread; |

运行结果:

1 | main thread print0 |

join 方法可以使子线程运行结束后再停止运行程序。

move 强制所有权迁移

这是一个经常遇到的情况:

1 | use std::thread; |

在子线程中尝试使用当前函数的资源,这一定是错误的!因为所有权机制禁止这种危险情况的产生,它将破坏所有权机制销毁资源的一定性。我们可以使用闭包的 move 关键字来处理:

1 | use std::thread; |

消息传递

Rust 中一个实现消息传递并发的主要工具是通道(channel),通道有两部分组成,一个发送者(transmitter)和一个接收者(receiver)。

std::sync::mpsc 包含了消息传递的方法:

1 | use std::thread; |

运行结果:

1 | Got: hi |

子线程获得了主线程的发送者 tx,并调用了它的 send 方法发送了一个字符串,然后主线程就通过对应的接收者 rx 接收到了。

Rust 异步编程 async/await

在现代编程中,异步编程变得越来越重要,因为它允许程序在等待 I/O 操作(如文件读写、网络通信等)时不被阻塞,从而提高性能和响应性。

异步编程是一种在 Rust 中处理非阻塞操作的方式,允许程序在执行长时间的 I/O 操作时不被阻塞,而是在等待的同时可以执行其他任务。

Rust 提供了多种工具和库来实现异步编程,包括 async 和 await 关键字、futures 和异步运行时(如 tokio、async-std 等),以及其他辅助工具。

- Future :Future 是 Rust 中表示异步操作的抽象。它是一个可能还没有完成的计算,将来某个时刻会返回一个值或一个错误。

- async/await :

async关键字用于定义一个异步函数,它返回一个 Future。await关键字用于暂停当前 Future 的执行,直到它完成。

实例

以下实例展示了如何使用 async 和 await 关键字编写一个异步函数,以及如何在异步函数中执行异步任务并等待其完成。

1 | // 引入所需的依赖库 |

以上代码中,我们首先定义了一个异步函数

async_task(),该函数模拟了一个异步操作,使用

tokio::time::delay_for() 方法来等待 1 秒钟,然后返回结果

42。接着定义了一个异步任务执行函数

execute_async_task(),在其中调用了异步函数,并使用

await 关键字等待异步任务的完成。最后在 main

函数中使用 tokio::main

宏来运行异步任务执行函数,并等待其完成。

运行该程序,可以看到程序输出了开始执行异步任务的提示,然后等待了 1 秒钟后输出了异步任务的结果,并最终输出了异步任务完成的提示:

1 | Start executing async task... |

这个例子演示了 Rust 中使用 async 和 await

关键字编写异步函数,以及如何在异步函数中执行异步任务并等待其完成。

以下实例使用 tokio 库执行异步 HTTP 请求,并输出响应结果:

1 | // 引入所需的依赖库 |

以上代码中,我们首先引入了 tokio 和 reqwest 库,分别用于执行异步任务和进行 HTTP 请求。然后定义了一个异步函数 fetch_url,用于执行异步的 HTTP GET 请求,并返回响应结果。

接着定义了一个异步任务执行函数 execute_async_task,该函数在其中发起了异步 HTTP 请求,并输出响应结果。

最后,在 main 函数中创建了一个 tokio 异步运行时,并在其中执行了异步任务,处理了异步任务的执行结果。

运行该程序,可以看到输出了异步 HTTP 请求的响应结果,实例中请求了 JSONPlaceholder 的一个帖子数据,并打印了其内容。

异步编程说明

async 关键字

async 关键字用于定义异步函数,即返回 Future 或 impl Future 类型的函数。异步函数执行时会返回一个未完成的 Future 对象,它表示一个尚未完成的计算或操作。

异步函数可以包含 await 表达式,用于等待其他异步操作的完成。

1 | async fn hello() -> String { |

await 关键字

await 关键字用于等待异步操作的完成,并获取其结果。

await 表达式只能在异步函数或异步块中使用,它会暂停当前的异步函数执行,等待被等待的 Future 完成,然后继续执行后续的代码。

1 | async fn print_hello() { |

异步函数返回值

异步函数的返回值类型通常是

impl Future<Output = T>,其中 T

是异步操作的结果类型。由于异步函数的返回值是一个 Future,因此可以使用

.await 来等待异步操作的完成,并获取其结果。

1 | async fn add(a: i32, b: i32) -> i32 { |

异步块

除了定义异步函数外,Rust

还提供了异步块的语法,可以在同步代码中使用异步操作。异步块由

async { } 构成,其中可以包含异步函数调用和

await 表达式。

1 | async { |

异步任务执行

在 Rust 中,异步任务通常需要在执行上下文中运行,可以使用

tokio::main、async-std 的

task::block_on 或 futures::executor::block_on

等函数来执行异步任务。这些函数会接受一个异步函数或异步块,并在当前线程或执行环境中执行它。

1 | use async_std::task; |

错误处理

await 后面跟一个 ? 操作符可以传播错误。如果

await 的 Future

完成时返回了一个错误,那么这个错误会被传播到调用者。

1 | async fn my_async_function() -> Result<(), MyError> { |

异步 trait 方法

Rust 允许为 trait 定义异步方法。这使得你可以为不同类型的对象定义异步操作。

1 | trait MyAsyncTrait { |

异步上下文

在 Rust 中,异步代码通常在异步运行时(如 Tokio 或 async-std)中执行。这些运行时提供了调度和执行异步任务的机制。

1 |

|

以上代码中,#[tokio::main] 属性宏将 main 函数包装在一个异步运行时中。

异步宏

Rust 提供了一些异步宏,如 tokio::spawn,用于在异步运行时中启动新的异步任务。

1 |

|

异步 I/O

Rust 的标准库提供了异步 I/O 操作,如 tokio::fs::File 和 async_std::fs::File。

1 | use tokio::fs::File; |

异步通道

Rust 的一些异步运行时提供了异步通道(如 tokio::sync::mpsc),允许在异步任务之间传递消息

1 | use tokio::sync::mpsc; |

.vscode 中tasks.json和launch.json的作用是什么?

在 .vscode 文件夹中:

tasks.json 的作用:

tasks.json 用于定义在 Visual Studio Code

中可以执行的任务。这些任务可以是编译代码、运行测试、执行脚本等各种自定义的操作。

例如,如果您正在开发一个使用特定编程语言的项目,您可以配置一个编译任务,指定编译器的命令和参数,以便在 VS Code 中轻松地编译您的代码。

再比如,您可能有一个需要在特定目录下运行的脚本,也可以在

tasks.json 中定义这个任务。

launch.json 的作用:

launch.json 主要用于配置调试(Debug)相关的设置。

它允许您定义如何启动和调试您的应用程序或脚本。您可以指定调试的类型(例如 Node.js、Python、Java 等)、启动的文件、传递的参数、环境变量等。

例如,如果您正在开发一个 Node.js 应用程序,您可以在

launch.json

中配置如何启动服务器,并在调试过程中设置断点、查看变量值等。

以下是一个简单的示例:

在 tasks.json 中定义一个简单的 JavaScript 编译任务:

1 | { |

在 launch.json 中定义一个 Node.js 调试配置:

1 | { |

在上述示例中,preLaunchTask 字段指定在调试之前先执行

Compile JavaScript 这个任务。

bpfcc在5.10内核上不可用解决:

需要重新编译bcc,参考这个文档 https://github.com/realwujing/ebpf-learning/blob/1d4dc60cef79a16354520fbda4f44b7013275e47/BCC.md

1)安装依赖 sudo apt-get -y install bison build-essential cmake flex git libedit-dev llvm-13-dev libclang-13-dev python zlib1g-dev libelf-dev libfl-dev python3-distutils

依赖里面 llvm-13-dev libclang-13-dev 没有,可以添加debian源,然后再下。 添加debian源方法: cat /etc/debian_version 确定debian版本,10对应buster,百度搜索debian 清华源 ,选择buster

2)下载代码: git clone https://github.com/iovisor/bcc.git git checkout -b v0.6.1 3)编译: 在执行git clone的目录写一个脚本 #!/bin/bash set -ex mkdir bcc/build cd bcc/build cmake .. make sudo make install cmake -DPYTHON_CMD=python3 .. # build python3 binding pushd src/python/ make sudo make install popd 然后执行 4)设置环境变量 需要先sudo -i echo "export PATH=$PATH:/usr/share/bcc/tools" >> /etc/profile sudo visudo后追加/usr/share/bcc/tools到secure_path后面 source /etc/profile

5)修改python默认指向python3 sudo update-alternatives --install /usr/bin/python python /usr/bin/python2 100 sudo update-alternatives --install /usr/bin/python python /usr/bin/python3 150 sudo update-alternatives --config python

编译出来的程序是trace; 直接 sudo trace运行,有时候需要重启

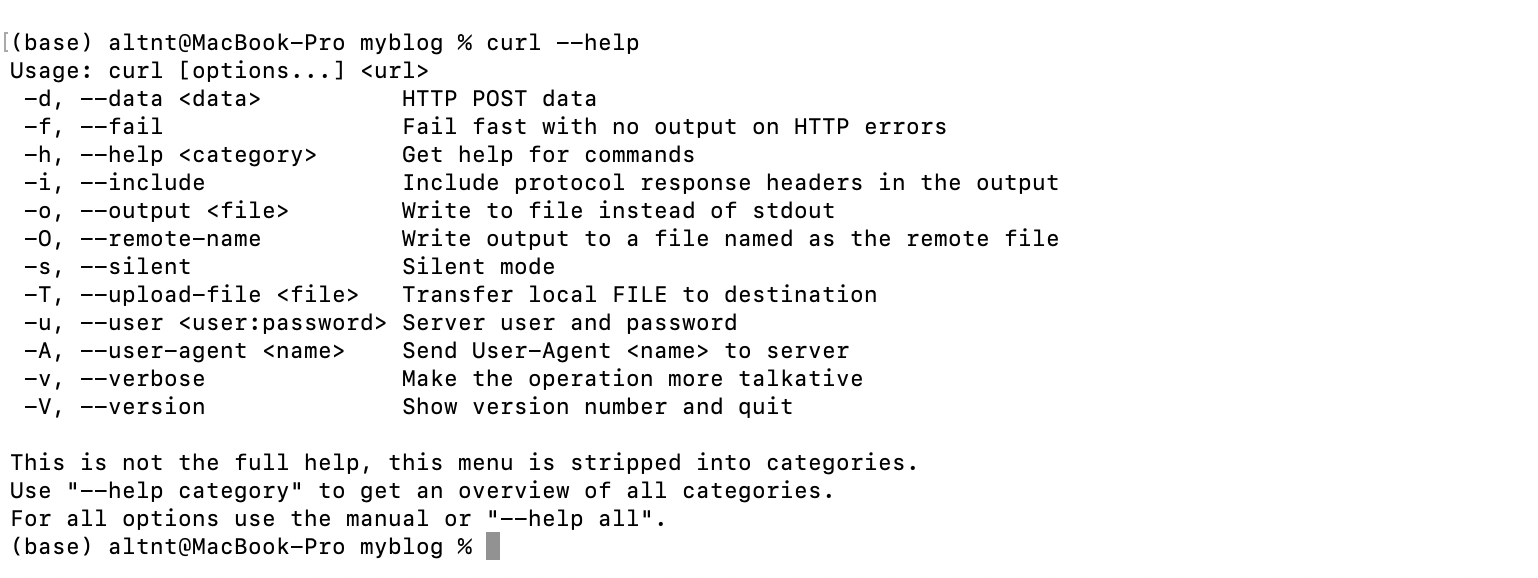

curl

curl 是一个用于通过各种网络协议(如 HTTP、FTP

等)获取数据的工具

1 | curl -O https://example.com/file.txt #-O 选项表示使用服务器上的文件名来保存下载的文件 |

内核编译:

284 ls arch/ 285 ls arch/arm64/configs/ 286 make merge_kirin990_armpc_defconfig 287 sudo apt install bison 288 make merge_kirin990_armpc_defconfig 289 sudo apt install flex 290 make merge_kirin990_armpc_defconfig 291 make menuconfig 292 lscpu 294 make bindeb-pkg -j10 编出来后安装linux-headerXXX.deb linux-image-xxx.deb

sudo apt install bison flex cp /boot/config-4.19.0-amd64-desktop arch/x86/configs/icbc_x86_defconfig make icbc_x86_defconfig make menuconfig 不需要 lscpu vim scripts/package/Makefile 注释掉deepin-apigail-generate的2行

查看回调函数具体调用的函数名 在Linux内核代码里面,很多结构体里面都有一些函数指针。在调试过程中,经常不知道该指针具体调用的是哪一个函数,那么有下面两种方法可以进行查看: 方法一:打印堆栈信息 在使用函数指针的后面,调用dump_stack()函数。这个函数会把堆栈信息打印出来,通过堆栈信息,就可以知道函数指针具体调用的是哪一个函数。 方法二:使用lookup_symbol_name函数 函数原型:int lookup_symbol_name(unsigned long addr, char *symname) 说明: addr参数-传入函数指针的值 symname参数-保存函数名字的首地址 注:要使用lookup_symbol_name函数,需要包含#include <linux/kallsyms.h>头文件 Oops: 0002 [#1] SMP 0002这个是 OOPS 信息的错误码

bit 0 0 means no page found, 1 means a protection fault bit 1 0 means read, 1 means write bit 2 0 means kernel, 1 means user-mode 位0 0 表示找不到页面,1表示保护故障 bit 1 0表示已读,1表示已写 位2 0 表示内核,1表示用户模式

[#1] — this value is the number of times the Oops occurred. Multiple Oops can be triggered as a cascading effect of the first one. 这个值是 Oops 发生的次数, 多个 Oops 可以级联效应触发

CPU: 0 PID: 1313 Comm: kworker/u4:0 Tainted: G D 3.14.52-1.1.1_ga #40 表示发生在CPU 0,当前运行的进程是1313 进程是kworker/u4:0 Tainted标识为:G 内核版本:3.14.52-1.1.1_ga 操作系统#40 ———————————————— 版权声明:本文为CSDN博主「monkey_lqd」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。 原文链接:https://blog.csdn.net/a3121772305/article/details/116885768

内核中函数指针用的很多,在debug 的时候能直接打印出一个函数指针对应的函数就会很方便。

打印裸指针(raw pointer)用 %p,%p除了可以用来打印指针外还可以打印其它的信息

%pF可打印函数指针的函数名和偏移地址,%pf只打印函数指针的函数名,不打印偏移地址。

如

printk("%pf %pF", ptr, ptr) will print:

module_start module_start+0x0/0x62 [hello]

但是为了支持这个功能你需要开启CONFIG_KALLSYMS 选项

打印函数栈 用户态 打印函数栈 使用backtrace()相关函数来达到输出函数栈的目的,man backtrace查看详细的参数,返回值等信息 简单说下这3个函数的用法:

int backtrace(void **buffer, int size); backtrace()把函数栈中的函数地址写到buffer数组,buffer数组的成员即void *类型。size表示把栈顶size个函数地址搞出来,如果想把函数栈完全搞出来,确保buffer数组和size足够大。

char backtrace_symbols(void const buffer, int size); void backtrace_symbols_fd(void const buffer, int size, int fd); backtrace_symbols()或者backtrace_symbols_fd()与上边的backtrace()配合使用,起一个翻译作用,即把函数地址翻译为函数名(还有函数的偏移和返回地址)。backtrace_symbols()把buffer数组中的size个元素翻译为函数名,把字符串数组保存在返回值char 中,自带了malloc功能,用完需把返回值free,见测试例。backtrace_symbols_fd()前两个参数和前者一样,但是把结果字符串数组输出到fd中,如fd=1,即输出到屏幕 由函数指针得到函数名 根据以上可以看出,backtrace_symbols和backtrace_symbols_fd可以用来将函数指针转换为函数名 内核态 打印函数栈 使用dump_stack()函数。直接在需要查看函数栈的位置加入这一句,然后dmesg中就可以看到函数栈了。

查找分区的uuid grub-probe -t fs_uuid /boot

bash :local a=0 声明一个局部变量 判断一个命令是否存在:if ! command

-v fsck >/dev/null 2>&1;then 将命令结果保存到指定目录logsave

-a -s

$$ Shell本身的PID(ProcessID)

获取当前终端 read -r console rest </proc/consoles

if [ "1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

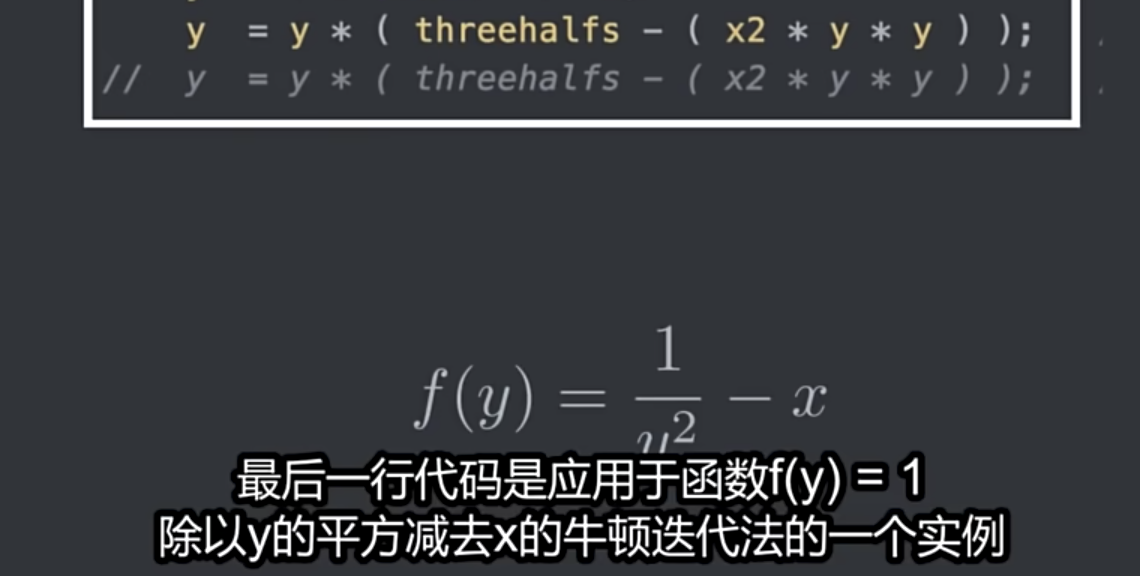

16float Q_rsqrt( float number )

{

long i;//占32位

float ×2, y;//均占32位

const float threehalfs = 1.5F;//1.5 also 32位

X2 = number * 0.5F;

y = number;

i = * ( long * ) &у;// evil floating point bit hack通过强制类型转换将浮点数 y 的地址当作长整型的地址来获取其底层的位表示

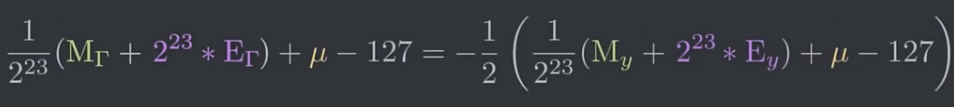

i = 0x5f3759df - ( i >> 1 );// what the fuck?

y = * (float * ) &i;//又通过强制类型转换将长整型 i 的位表示转换回浮点数赋值给 y

y = y * ( threehalfs - ( x2 * y * y ) );// 1st iteration

// y = y * ( threehalfs - ( x2 * y * y ) );// 2nd iteration, can be removed

return y;

}

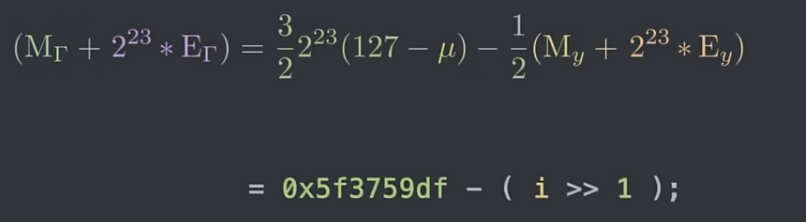

上面的

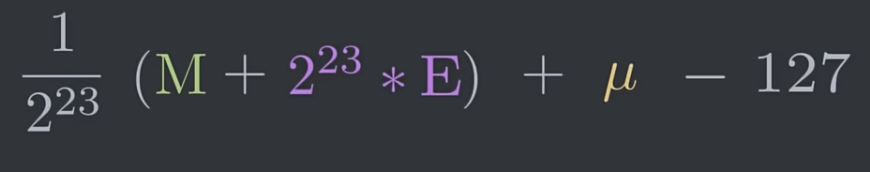

i = * ( long * ) &у实际就等于M+2^23*E,其中M和E是y这个浮点数用IEEE754表示法的尾数和指数(实际把32位数写出来再看很好理解)

log2(y)=

至于上面这个公式实际就是计算log2(y)的近似值,推导过程见视频,其中上面的mu是一个0到1的未确定的值,但会使得约等于的两边取得最小的误差

所以经过 i = * ( long * ) &у后,i会约等于log2(y)

而log(1/(y^1/2))=-1/2log2(y)=-(y>>1)

y = * (float * ) &i;//又通过强制类型转换将长整型 i 的位表示转换回浮点数赋值给 y这一步就不讲了,跟上面的步骤反过来就是了

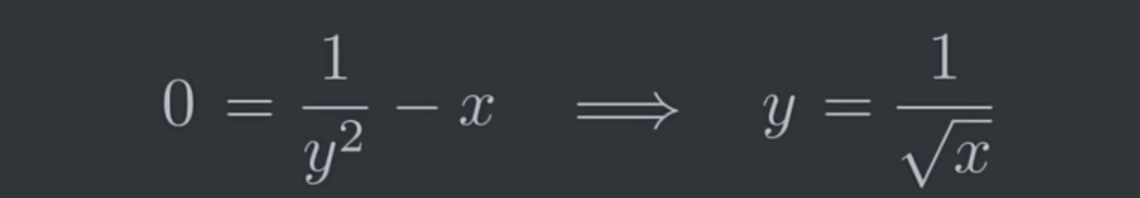

y = y * ( threehalfs - ( x2 * y * y ) );// 1st iteration

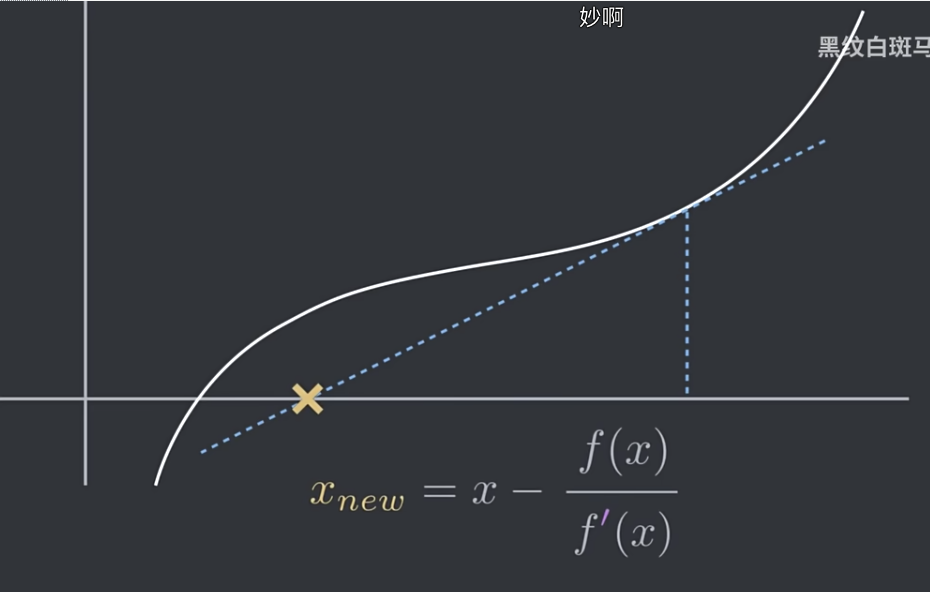

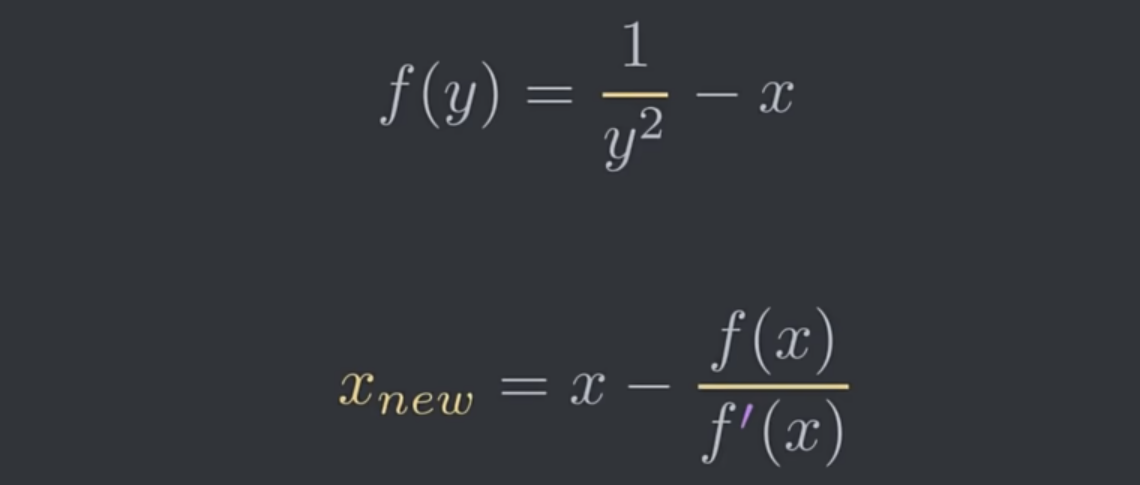

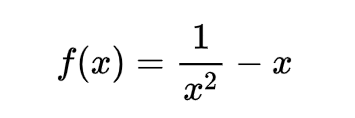

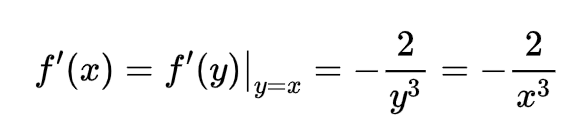

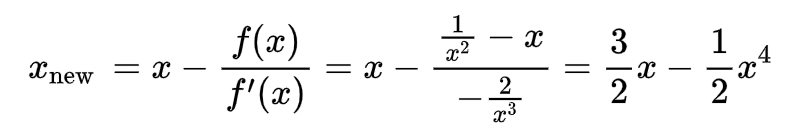

经过上面的步骤,我们得到一个不错的近似值,但同时也引入了一些误差项,得益于牛顿迭代法,可以从一个相当不错的近似值出发,得到一个相当精确的近似结果

牛顿迭代法(Newton's Method)

牛顿迭代法是一种用于求解方程根的数值方法。

它的基本思想是通过不断地用切线来逼近函数的根。

假设我们要求解方程 f(x) = 0

的根,首先我们需要选取一个初始的近似值 x0 。

然后,通过以下公式进行迭代计算:

x(n + 1) = x(n) - f(x(n)) / f'(x(n))

其中 f'(x) 是函数 f(x) 的导数。

每次迭代都会使新的近似值更接近方程的根。

例如,要求解方程 x^2 - 5 = 0 ,其导数为 2x

。

假设初始近似值 x0 = 2 ,则:

第一次迭代:x1 = 2 - (2^2 - 5) / (2 * 2) = 2.25

第二次迭代:x2 = 2.25 - (2.25^2 - 5) / (2 * 2.25) ≈ 2.2361

以此类推,不断迭代,逐渐逼近方程的根。

牛顿迭代法的优点是收敛速度较快,但它也有一些局限性。比如,要求函数在根的附近具有较好的性质,且导数的计算要准确和方便。

在实际应用中,牛顿迭代法常用于求解非线性方程、计算函数的零点、优化问题等领域。

对于 y = y * (threehalfs - (x2 * y * y))

这一行,它是牛顿迭代法的应用。

Whether in the real environment

real_env=1 if [ -f /bin/dde-dock ]; then real_env=0 LOG_FILE=/tmp/$PROJ.log fi

shell log: log_info() { echo "$*" >&2 echo "TUI:

trap用法: trap clean_boot EXIT 起因 项目中的升级脚本可能耗时很长,在这段时间内,脚本没有任何输出的,这带给市场部署人员的感觉就是脚本好像卡住了。通常情况下,部署人员都会直接CTRL+C停掉升级脚本,这会导致升级失败,最终需要开发人员介入去修复环境。

可以通过输出升级进度的方式提示部署人员升级正在进行中,但进度也可能在一段时间不动,而且无法避免意外终止升级的情况,此时可以使用Shell的内建命令trap来忽略SIGINT这些信号,保证升级不会中断。 trap [-lp] [[arg] sigspec ...] arg可以是shell命令或者自定义函数 sigspec可以是以下的一个或多个 定义在<signal.h>中的信号名或者数值。信号名的大小写不敏感,SIG这个前缀也是可选的。以下的命令的效果都是一样的 trap "echo 123" SIGINT trap "echo 123" INT trap "echo 123" 2 trap "echo 123" int trap "echo 123" Int EXIT:在shell退出前执行trap设置的命令,也可以指定为0 RETURN:在函数返回时,或者.和source执行其他脚本返回时,执行trap设置的命令 DEBUG:在任何命令执行前执行trap设置的命令,但对于函数仅在函数的第一条命令前执行一次

shell中判断语句if中-z 和 -n

[ -a FILE ] 如果 FILE 存在则为真。

[ -b FILE ] 如果 FILE 存在且是一个块特殊文件则为真。

[ -c FILE ] 如果 FILE 存在且是一个字特殊文件则为真。

[ -d FILE ] 如果 FILE 存在且是一个目录则为真。

[ -e FILE ] 如果 FILE 存在则为真。

[ -f FILE ] 如果 FILE 存在且是一个普通文件则为真。

[ -g FILE ] 如果 FILE 存在且已经设置了SGID则为真。

[ -h FILE ] 如果 FILE 存在且是一个符号连接则为真。

[ -k FILE ] 如果 FILE 存在且已经设置了粘制位则为真。

[ -p FILE ] 如果 FILE 存在且是一个名字管道(F如果O)则为真。

[ -r FILE ] 如果 FILE 存在且是可读的则为真。

[ -s FILE ] 如果 FILE 存在且大小不为0则为真。

[ -t FD ] 如果文件描述符 FD 打开且指向一个终端则为真。

[ -u FILE ] 如果 FILE 存在且设置了SUID (set user ID)则为真。

[ -w FILE ] 如果 FILE 如果 FILE 存在且是可写的则为真。

[ -x FILE ] 如果 FILE 存在且是可执行的则为真。

[ -O FILE ] 如果 FILE 存在且属有效用户ID则为真。

[ -G FILE ] 如果 FILE 存在且属有效用户组则为真。

[ -L FILE ] 如果 FILE 存在且是一个符号连接则为真。

[ -N FILE ] 如果 FILE 存在 and has been mod如果ied since it was last read则为真。

[ -S FILE ] 如果 FILE 存在且是一个套接字则为真。

[ FILE1 -nt FILE2 ] 如果 FILE1 has been changed more recently than FILE2, or 如果 FILE1 exists and FILE2 does not则为真。

[ FILE1 -ot FILE2 ] 如果 FILE1 比 FILE2 要老, 或者 FILE2 存在且 FILE1 不存在则为真。

[ FILE1 -ef FILE2 ] 如果 FILE1 和 FILE2 指向相同的设备和节点号则为真。

[ -o OPTIONNAME ] 如果 shell选项 “OPTIONNAME” 开启则为真。

[ -z STRING ] “STRING” 的长度为零则为真。

[ -n STRING ] or [ STRING ] “STRING” 的长度为非零 non-zero则为真。

[ STRING1 == STRING2 ] 如果2个字符串相同。 “=” may be used instead of “==” for strict POSIX compliance则为真。

[ STRING1 != STRING2 ] 如果字符串不相等则为真。

[ STRING1 < STRING2 ] 如果 “STRING1” sorts before “STRING2” lexicographically in the current locale则为真。

[ STRING1 > STRING2 ] 如果 “STRING1” sorts after “STRING2” lexicographically in the current locale则为真。

[ ARG1 OP ARG2 ] “OP” is one of -eq, -ne, -lt, -le, -gt or -ge. These arithmetic binary operators return true if “ARG1” is equal to, not equal to, less than, less than or equal to, greater than, or greater than or equal to “ARG2”, respectively. “ARG1” and “ARG2” are integers.

cat /proc/net/netlink| grep sockid 这里面的基本都是内核传的socket sudo netstat -x | grep sockid sudo netstat -xp| grep proc cat /proc/net/unix | grep sockid

给u盘改名: sudo mlabel -i /dev/sda ::LL (label是名字)

例子:

sudo mlabel -i /dev/sda ::recovery格式化U盘:

sudo mkfs.btrfs -f /dev/sdc

下载wpa最上游源码:

git clone git://w1.fi/srv/git/hostap.git

使用wpa开热点:

ctrl_interface=/var/run/wpa_supplicant update_config=1 ap_scan=2

network={ ssid="A-WPA3-TEST" mode=2 key_mgmt=SAE proto=RSN pairwise=CCMP psk="12345678" sae_password="12345678" ieee80211w=2 } wpa_supplicant -Dnl80211 -iwlan0 -c wpa_supplicant.conf

删除已连接的网络:

删除/etc/NetworkManager/system-connections/下,然后重启NetworkManager

vim快捷键

这几个常用:

向上翻半页`ctrl+u`- 向后翻半页:

ctrl+d - 向后翻整页:

ctrl+f - 向前翻整页:

ctrl+b

突出显示字符: set hls

1 | :set number |

vim快速跳转

一.按单词跳转(可以跨行跳转)

w <---> b 跳转到下个/上个单词的第一个字符处

e <---> ge 跳转到下个/上个单词的最后一个字符处

二.行内跳转

0 跳转到光标所在行的行首

$ 跳转到光标所在行的行尾

n| 跳转到光标所在行的指定列

三.行内查找并跳转

f 命令移动到光标右边的指定字符上,例如,"fm",会把移动到光标右边的第一个'm'字符上

F 命令则反方向查找,也就是移动到光标左边的指定字符上

t 命令和”f“命令的区别在于,它移动到光标右边的指定字符之前

T 命令是”t“命令的反向版本,它移动到光标右边的指定字符之后

; 命令重复前一次输入的f, t, F, T命令,

, 命令会反方向重复前一次输入的f, t, F, T命令

可以在这组命令前面使用数字,表示倍数。例如,"6fm"表示移动到光标右边的第6个'm'字符上

四、 跳转指定行

比如想跳转到文本的第12行,可以执行如下命令:

(1)12gg / 12G(建议使用这种,因为ngg/nG输入以后不需要按下回车键,而输入:n之后还要按下回车键才会跳转)

(2):12

(3)打开文件时输入vim +12 filename

五、往上或往下跳n行

5k :往上跳 5 行

5j: 往下跳 5 行

vim替换模式

使用大写

R命令,将进入替换模式(屏幕底部显示“--REPLACE--”)。此时新输入的文本将直接替代/覆盖已经存在的内容,直至点击ESC键返回常规模式。

使用小写

r命令,将进入单字符替换模式,此时新输入的字符将替代光标之下的当前字符,然后自动返回到常规模式。

通过在r命令中增加数字前缀,可以一次性替换多个字符。例如,将光标定位到“||”字符处,然后执行

2r&命令,可以将其替换为“&&”。

Vim中启用鼠标:

set mouse =a #这将在所有模式下启用鼠标。如果你只想在特定模式下启用鼠标,可以将上述配置中的“a”替换为对应的模式。各模式的区别如下:

1 | Enable the use of the mouse. Works for most terminals (xterm, Win32 |

在Vim中,鼠标可以用于启动各种模式。当你将鼠标光标移动到屏幕边缘时,Vim将自动切换到相应的模式。例如,将光标移动到屏幕底部边缘将切换到Normal模式,移动到屏幕左侧边缘将切换到Visual模式,移动到屏幕右侧边缘将切换到Insert模式。 除了在屏幕边缘切换模式外,你还可以使用鼠标右键菜单来切换模式。在Normal模式下,将鼠标光标移动到屏幕边缘并单击右键,将弹出一个菜单,你可以从中选择要切换到的模式。

需要注意的是,启用鼠标后可能会影响Vim的操作体验。因为在Vim中,键盘快捷键是主要的操作方式,而鼠标操作可能会打破这种习惯。此外,Vim中的许多功能是通过键盘快捷键实现的,启用鼠标后可能会与这些快捷键产生冲突。因此,如果你是一个习惯使用键盘快捷键的Vim用户,建议慎重考虑是否启用鼠标。

查看vim是否支持剪切板

vim --version| grep "clipboard" 不支持的话安装: sudo apt install vim-gtk

- 使用快捷键# "+y和"+p的输入挺麻烦的,我们直接为他们创建个快捷键吧

vim创建快捷键的原理可以看 jalused的博客

我使用的快捷键如下

" 支持在Visual模式下,通过C-y复制到系统剪切板 vnoremap

<C-y> "+y " 支持在normal模式下,通过C-p粘贴系统剪切板

nnoremap <C-p> "*p

将上面的内容copy到~/.vimrc中即可生效,效果就是:

在vim的visual模式下选中了要复制的内容,再用Ctrl + y复制到系统剪切板,直接去其他窗口中Ctrl + v粘贴 在其他窗口中选择之后(不一定要Ctrl + c),可直接在vim中用Ctrl + p来粘贴 "语法高亮度显示 syntax on "下面两行在进行编写代码时,在格式对起上很有用; "第一行,vim使用自动对起,也就是把当前行的对起格式应用到下一行; "第二行,依据上面的对起格式,智能的选择对起方式,对于类似C语言编 "写上很有用 set autoindent set smartindent "在编辑过程中,在右下角显示光标位置的状态行 set ruler

cpio格式 initrd 的解压与压缩:

https://blog.csdn.net/feisang/article/details/6121269 https://blog.sina.com.cn/s/blog_6795385f0100kdb7.html

加载initrd的过程: http://blog.chinaunix.net/uid-29073321-id-5570250.html

第二部分:initrd、initramfs